La Expansión de la IA Presiona la Infraestructura Eléctrica Global, Exigiendo Avances en Chips, Refrigeración y Programación para Evitar un Colapso Energético en el Sector

La expansión acelerada de la inteligencia artificial (IA) ha traído preocupaciones serias sobre el consumo de energía. La industria está intentando contener este impacto con mejoras en chips, sistemas de refrigeración y programación. Pero los desafíos aún son grandes.

La IA depende fuertemente de centros de datos, que concentran el poder de procesamiento necesario para operar los sistemas.

Según la Agencia Internacional de Energía, estos centros pueden consumir hasta el 3% de toda la electricidad mundial hasta 2030. Esto representa el doble de lo que utilizan actualmente.

-

La inteligencia artificial está disparando el consumo de energía, elevando las emisiones de los gigantes de la tecnología y empujando a Google, Microsoft y Meta más cerca del gas natural.

-

Mercor pagó 1,5 millones de dólares por día para que médicos, abogados y ex-banquero de Goldman Sachs enseñaran a la inteligencia artificial a hacer su trabajo y, en 17 meses, pasó de cero a 500 millones de dólares en ingresos anuales mientras sus propios contratados aceleran la sustitución de su propio trabajo.

-

Casio presenta a Moflin, una mascota robótica con inteligencia artificial creada para ofrecer confort emocional y simular un vínculo afectivo permanente.

-

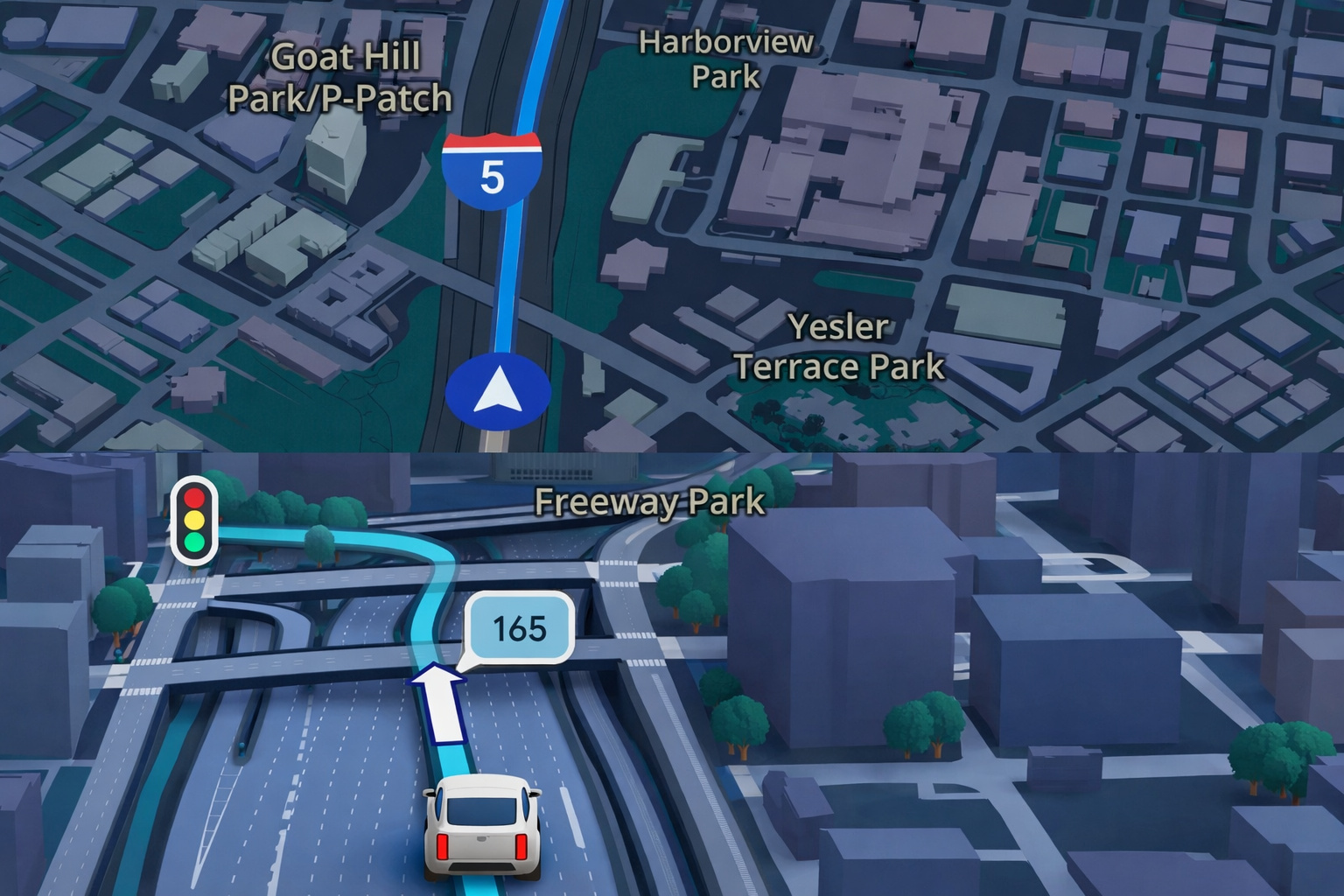

Google Maps revoluciona la navegación por GPS con la inteligencia artificial Gemini, la función Ask Maps y visualización 3D avanzada para la planificación de rutas y viajes

Expertos de la consultoría McKinsey advierten que hay una carrera para construir más centros de datos. Al mismo tiempo, crece el riesgo de escasez de electricidad en el mundo.

La presión aumenta para encontrar soluciones que disminuyan este consumo.

Mosharaf Chowdhury, profesor de la Universidad de Michigan, afirma que hay dos caminos posibles. El primero es ampliar el suministro de energía —algo que lleva tiempo y ya están buscando las gigantes de la IA en diversas partes del planeta.

El segundo es reducir el gasto energético manteniendo el mismo rendimiento.

Chowdhury cree que la salida está en soluciones inteligentes, que involucran desde el hardware hasta el software.

Su laboratorio ha desarrollado algoritmos que calculan con precisión la energía necesaria para cada chip. Esto ya ha permitido reducir el consumo entre un 20% y un 30%.

Cambios en la refrigeración de los servidores también hacen una diferencia. En el pasado, operar un centro de datos requería casi la misma energía para refrigeración y operación de los servidores.

Hoy, la refrigeración consume solo el 10% del total, según Gareth Williams, de la consultoría Arup.

Esto sucede debido al avance en la eficiencia energética. Muchos centros ahora utilizan sensores con IA para ajustar la temperatura en zonas específicas, en lugar de refrigerar todo el edificio de manera uniforme.

Este control en tiempo real permite ahorrar agua y electricidad, afirma Pankaj Sachdeva, de McKinsey.

Una innovación prometedora es la refrigeración líquida. En lugar de usar aire acondicionado tradicional, el sistema utiliza líquidos que circulan directamente a través de los servidores.

Todos los grandes actores de la industria están apostando por esta tecnología, según Williams.

Este avance es importante porque los chips modernos, como los de Nvidia, consumen hasta 100 veces más energía que los servidores de hace veinte años. Por eso, la demanda por formas más eficientes de refrigeración solo crece.

La AWS, empresa de computación en la nube de Amazon, anunció que creó un sistema propio de refrigeración líquida para sus chips Nvidia.

El método evita que los centros de datos necesiten ser reconstruidos desde cero. Según Dave Brown, vicepresidente de AWS, no habría capacidad suficiente para aplicar el modelo tradicional de refrigeración líquida a gran escala.

Además de la parte física, los chips de computadora también están volviéndose más eficientes. Sachdeva destaca que cada nueva generación consume menos energía.

Una investigación realizada por Yi Ding, de la Universidad Purdue, confirma que los chips de IA pueden durar más tiempo sin perder rendimiento.

Aún así, Ding reconoce un obstáculo. Él dice que es difícil convencer a los fabricantes a vender menos chips, incentivando a los clientes a mantener los mismos equipos por más tiempo. La presión por lucro aún pesa.

A pesar de los avances, el aumento en el consumo total de energía parece inevitable. «El consumo de energía seguirá aumentando», afirma Ding. La buena noticia, según él, es que tal vez el crecimiento no sea tan acelerado como antes.

En Estados Unidos, la energía se ha convertido en un tema estratégico para mantener la liderazgo en IA frente a China.

En enero, la startup china DeepSeek presentó un modelo que se equipara a los principales sistemas americanos, incluso usando chips más débiles y menos energía.

La DeepSeek logró este resultado al programar sus GPUs con más precisión. La empresa también saltó una etapa de entrenamiento de los modelos, que consumía mucha energía y antes se consideraba indispensable.

El avance llamó la atención. Hay quienes ven a China en ventaja por contar con más fuentes de energía disponibles, como las renovables y nucleares. Esto preocupa a Estados Unidos, que está tratando de reaccionar para no perder terreno.

El sector ahora busca soluciones urgentes. Después de todo, con el crecimiento de la IA, mantener el equilibrio entre innovación y sostenibilidad se ha vuelto una exigencia —y no solo una elección.

Con información de Science Alert.

Portugués

Portugués  Inglés

Inglés  Español

Español

Seja o primeiro a reagir!