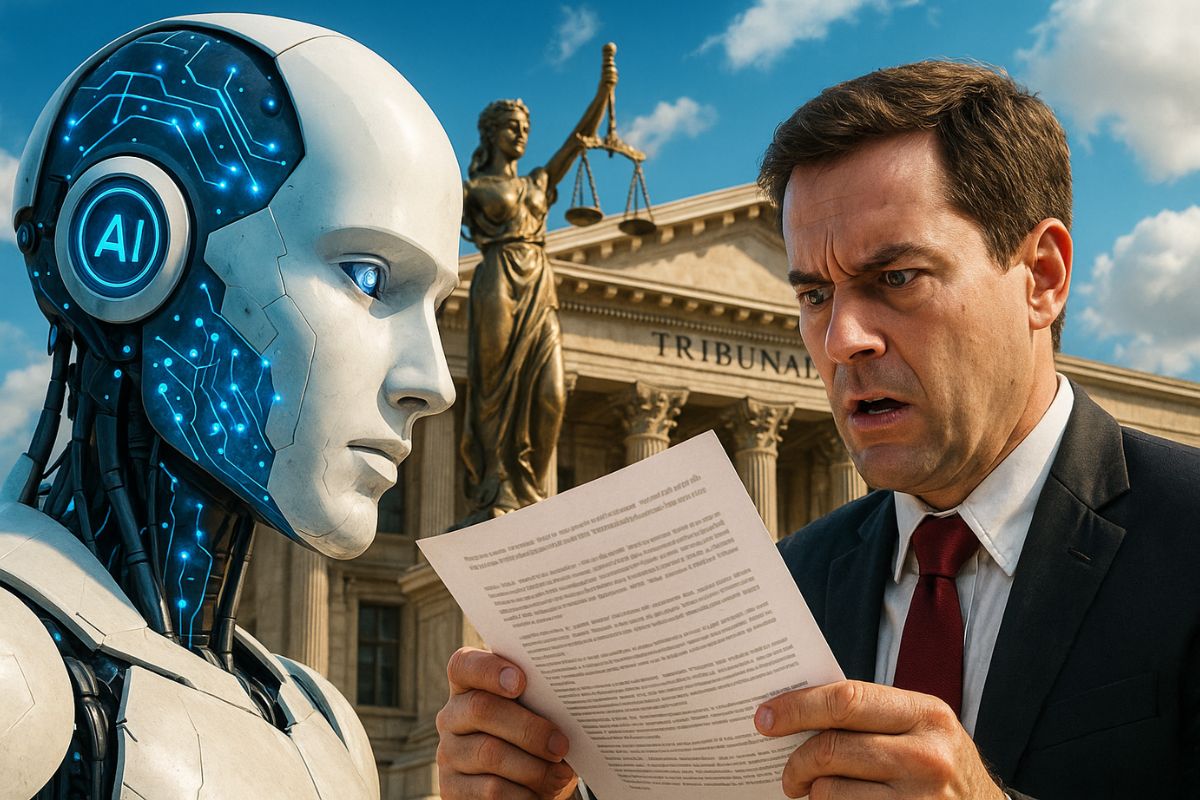

Tribunal de California Aplicó Multa de US$ 10 Mil Tras Detectar Petición con Citaciones Falsas Creada por ChatGPT.

Un caso inédito expuso los riesgos del uso de la inteligencia artificial en el Derecho. El Tribunal de Recursos del 2º Distrito de California multó con US$ 10 mil al abogado Amir Mostafavi, quien presentó una petición llena de citas jurídicas falsas producidas por ChatGPT.

Según el Conjur, 21 de las 23 referencias incluidas en el documento eran fabricadas, lo que llevó a la corte a transformar el proceso en un ejemplo para todo el sistema judicial.

La decisión fue publicada incluso en circunstancias que normalmente no justificarían divulgación, justamente para advertir a abogados y jueces sobre los peligros de la confianza ciega en herramientas de IA.

-

La Cámara aprueba un proyecto que permite el uso de spray de pimienta para mujeres mayores de 16 años y establece reglas estrictas para su compra, posesión y uso como defensa personal.

-

La Cámara aprueba ley para combatir la leucaena, planta de rápido crecimiento que domina terrenos y amenaza a especies nativas en varias regiones del país.

-

División de bienes: descubre qué no se puede dividir en caso de separación

-

Empleado de banco crea cuenta en línea a nombre de un cliente que había fallecido meses antes, desvía más de R$ 385 mil en transferencias electrónicas y es condenado a 15 años de prisión en San Salvador tras el descubrimiento del esquema iniciado en agosto de 2021.

El Caso que Encendió la Alerta

La petición de Mostafavi llamó la atención porque incluía precedentes inexistentes o incorrectos.

El tribunal destacó que las llamadas “alucinaciones” de la IA respuestas que parecen plausibles, pero no corresponden a la realidad crearon jurisprudencias que simplemente no existían.

La corte fue categórica: el abogado falló al no chequear el contenido producido por la herramienta.

Para los jueces, no hay nada de malo en usar tecnología en el proceso jurídico, pero el deber de verificación es exclusivo del profesional.

Sanciones y Efecto Pedagógico

Además de la multa de US$ 10 mil, el tribunal determinó que Mostafavi entregara copias de la decisión a su cliente y a la sección de la American Bar Association en California.

El objetivo es ampliar la discusión sobre ética profesional y producir guías de conducta enfocadas en el uso responsable de la IA en el Derecho.

De acuerdo con el Conjur, el colegiado de tres jueces dejó claro que la pena sirve como advertencia para toda la comunidad jurídica.

La publicación de la decisión fue considerada necesaria ante el aumento exponencial de casos similares en los tribunales norteamericanos.

Problema en Crecimiento

Estudios recientes apuntan que hasta tres de cada cuatro abogados ya utilizan herramientas de IA generativa en el trabajo.

El problema es que, en alrededor de un tercio de las situaciones, los modelos terminan presentando información falsa o distorsionada.

Investigadores como Damien Charlotin y Nicholas Sanctis afirman que el número de casos de este tipo está creciendo mes a mes.

Si antes se registraban pocas ocurrencias esporádicas, hoy los relatos llegan a decenas por semana, en diferentes áreas del Poder Judicial.

El Impacto para la Justicia

El tribunal resaltó que acciones frívolas oneran todo el sistema, desviando tiempo y recursos que podrían ser dedicados a litigios legítimos.

La decisión también llamó la atención para los contribuyentes, que terminan asumiendo costos adicionales cuando la Justicia necesita revisar e investigar peticiones basadas en falsedades.

Especialistas afirman que la tendencia es de agravamiento a corto plazo. Muchos modelos de lenguaje priorizan dar respuestas, incluso cuando no tienen datos confiables, lo que incrementa la probabilidad de errores.

Límites de la Tecnología en el Derecho

A pesar de los riesgos, la corte reconoció que la inteligencia artificial en el Derecho puede ser una herramienta útil, siempre que se use con responsabilidad.

Para los jueces, no corresponde a la IA sustituir el trabajo crítico de los abogados, sino solo auxiliarles en investigaciones y tareas preliminares.

El mensaje es claro: la tecnología no elimina la necesidad de lectura atenta y verificación rigurosa.

Abogados que deleguen totalmente la elaboración de argumentos jurídicos a las máquinas pueden poner en riesgo no solo a sus clientes, sino también la credibilidad de la Justicia.

El caso de Amir Mostafavi muestra cómo la dependencia ciega de la tecnología puede traer consecuencias graves, incluso para profesionales experimentados.

Al mismo tiempo, refuerza el debate sobre los límites y responsabilidades en el uso de la inteligencia artificial en el Derecho.

¿Y tú, crees que la IA debe tener mayor espacio en el sistema judicial o que su uso debe ser restringido para evitar abusos?

Deja tu opinión en los comentarios, queremos escuchar tu análisis sobre este desafío ético y tecnológico.

Português

Português  Inglês

Inglês  Espanhol

Espanhol

Minha PETIÇÃO acabou de subir ao Conselho Nacional de Justiça – CNJ com o uso escancarado da AI, pois a tecnologia deve estar ao nosso serviço, inclusive o(a) ADVOGADO(A) deve falar na própria petição sobre o uso da AI, pois esta atitude demonstra superioridade à qualquer máquina!!! Nós nos tornamos superiores quando colocamos a AI no patamar de serviçal da humanidade

Link da PETIÇÃO: https://drive.google.com/file/d/1LBeMbDADyRBXl9i5nUPmBI7lUDMdQkuV/view?usp=drivesdk

Boa tarde, seu e-mail de cadastro de comentário aqui no blog é o que podemos entrar em contato para sabermos mais sobre a petição?

Eu entendo que a IA é somente uma auxiliar, não só na justiça, como em todas as outras profissões. Mas não pode passar disso. A responsabilidade final é do ser humano, o profissional. E deve haver sempre a checagem.