Sam Altman, de OpenAI, afirma que interações sensíveis com inteligência artificial não têm a mesma proteção legal de sessões com psicólogos

O CEO do ChatGPT alerta que conversas íntimas com a inteligência artificial podem ser expostas em processos judiciais. Em entrevista recente, Sam Altman chamou atenção para o uso do chatbot como terapeuta informal, alertando que la IA no garantiza confidencialidad como ocorre com profissionais de saúde mental.

É urgente establecer regras claras para proteger a privacidade dos usuários que compartilham questões sensíveis com o ChatGPT, especialmente jovens que usam a IA como coach, conselheiro ou “ouvinte” em momentos de vulnerabilidade.

Conversas com IA não têm sigilo legal garantido

Durante a entrevista, Sam Altman revelou preocupação com a maneira como adolescentes e adultos estão utilizando o ChatGPT para fines terapéuticos. Ele comparou essa prática ao atendimento com médicos ou advogados, que contam com respaldo jurídico de sigilo profissional, algo que no se aplica al ChatGPT.

-

Una “habilidad silenciosa” está haciendo que brasileños ganen hasta R$ 22 mil al mes sin diploma y se conviertan en indispensables para empresas que dependen de millones de datos para sobrevivir.

-

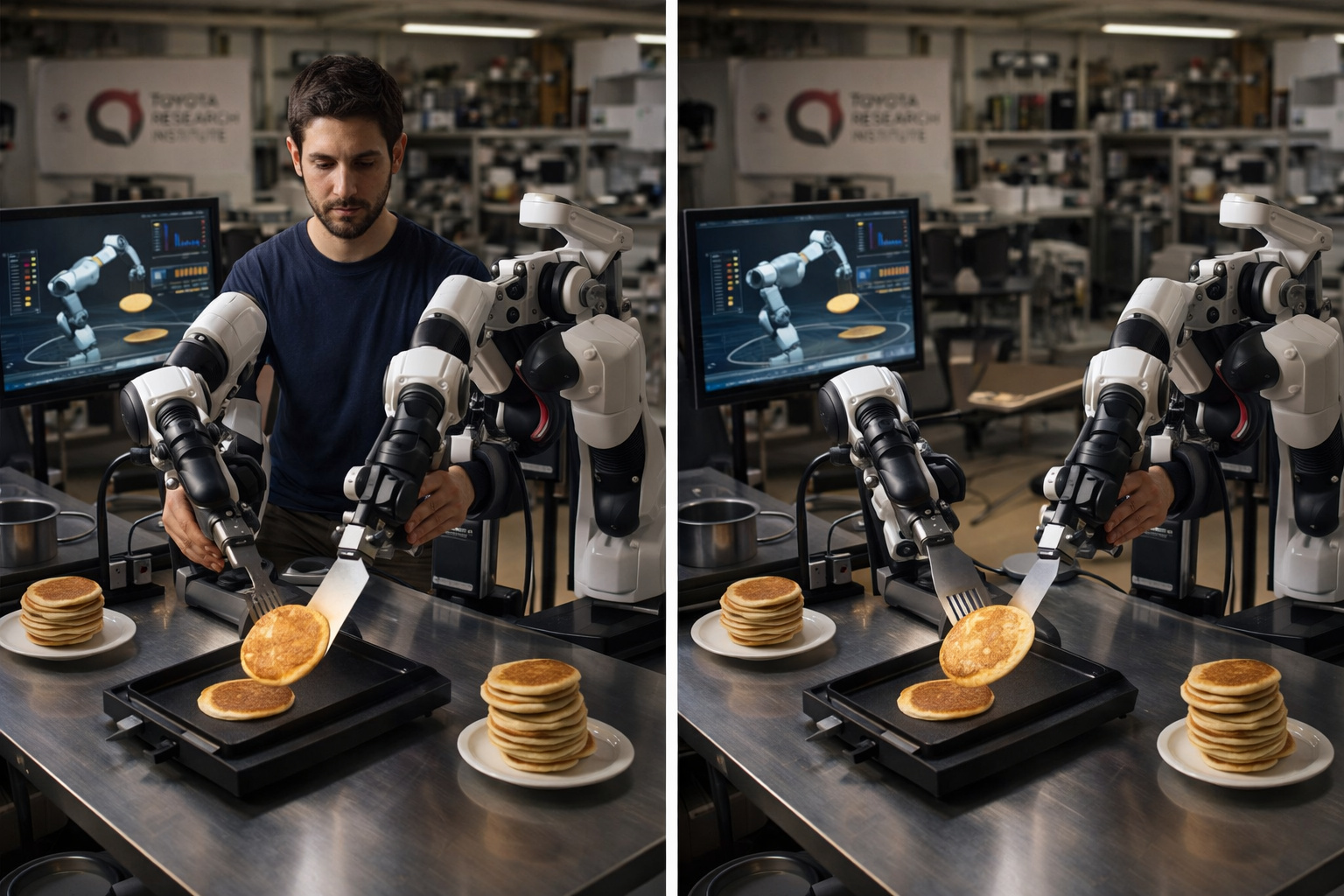

Investigadores del Toyota Research Institute descubrieron que, si un humano usa brazos robóticos para voltear una pancake 300 veces en una tarde, el robot aprende a hacerlo solo a la mañana siguiente, y este es hoy el método más prometedor para resolver el mayor cuello de botella de la robótica moderna.

-

Adiós plancha: un artículo común en los hogares comienza a perder espacio frente a la tecnología que alisa la ropa en minutos sin tabla y con menos consumo de energía.

-

Antártida revela una pista inusual en lo alto de las montañas Hudson, y lo que parecía ser solo una roca aislada comenzó a exponer un secreto guardado bajo el hielo durante eras.

«Neste momento, se você conversar com um terapeuta, um advogado ou um médico sobre esses problemas, existe um privilégio legal para isso. Ainda não descobrimos isso para quando você fala com o ChatGPT», declarou o CEO da OpenAI.

Segundo as políticas da empresa, las interacciones con la IA pueden ser leídas por moderadores e armazenadas por até 30 dias, mesmo que o usuário delete o histórico. E mais: casos judiciais podem obrigar a OpenAI a divulgar essas conversas, inclusive chats já apagados.

Dados podem ser usados até mesmo contra o usuário

Além da retenção temporária, o conteúdo das conversas é utilizado para treinar o modelo e identificar usos indebidos de la plataforma. Isso significa que, al contrário de apps como WhatsApp ou Signal, que usam criptografia de ponta a ponta, o ChatGPT puede registrar y revisar todo lo que se dice en la conversación.

A discussão sobre privacidade se intensificou após um processo movido em junho de 2025 por veículos como The New York Times, que exigiram judicialmente a preservação de registros da OpenAI — inclusive chats excluídos. A empresa está recorrendo da decisão, que se insere em uma disputa maior sobre direitos autorais e acesso a dados de usuários.

ChatGPT é ferramenta, não substituto de terapia

A fala de Altman também serve de alerta sobre la confusión entre tecnología y cuidado emocional. Embora o ChatGPT possa oferecer suporte em linguagem clara e amigável, no reemplaza la escucha clínica de un psicólogo, nem possui obrigações legais quanto ao sigilo das conversas.

Especialistas refuerzan que, para temas sensíveis como saúde mental, traumas ou decisões pessoais delicadas, el mejor camino sigue siendo buscar ayuda profesional, onde há respaldo ético, técnico e jurídico. A IA, nesse caso, deve ser vista como um recurso complementar — nunca como substituto.

¿Has usado IA para desahogarte o pedir consejos? ¿Crees que debería ofrecer confidencialidad como los profesionales de la salud? Deja tu opinión en los comentarios.

Portugués

Portugués  Inglés

Inglés  Español

Español

Seja o primeiro a reagir!