Declaraciones de China, enfrentamiento con el Pentágono y límites de la inteligencia artificial militar vuelven a colocar en el centro del debate internacional los riesgos, las restricciones y la disputa política en torno al uso de sistemas autónomos en decisiones de guerra.

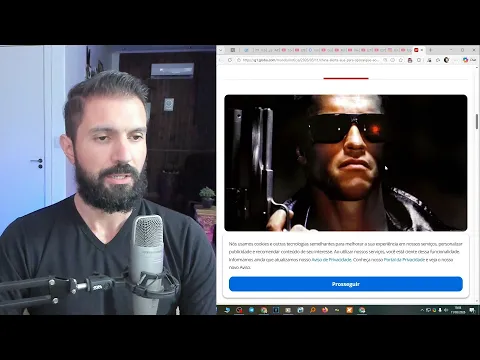

China criticó la ampliación del uso militar de la inteligencia artificial por parte de Estados Unidos y afirmó que la adopción sin límites de esta tecnología puede llevar a escenarios similares al retratado en “Terminator”.

La declaración fue hecha por el portavoz del Ministerio de Defensa chino, Jiang Bin, en medio del impasse entre el Pentágono y la startup estadounidense Anthropic sobre restricciones al uso de sistemas de IA en operaciones militares.

La manifestación ocurrió en un momento de aumento de la discusión en Estados Unidos sobre los límites éticos de la inteligencia artificial aplicada al área de defensa.

-

Misterio de 350 años podría haber terminado: restos mortales de un militar que inspiró al héroe de Los Tres Mosqueteros aparecen bajo una iglesia en Holanda.

-

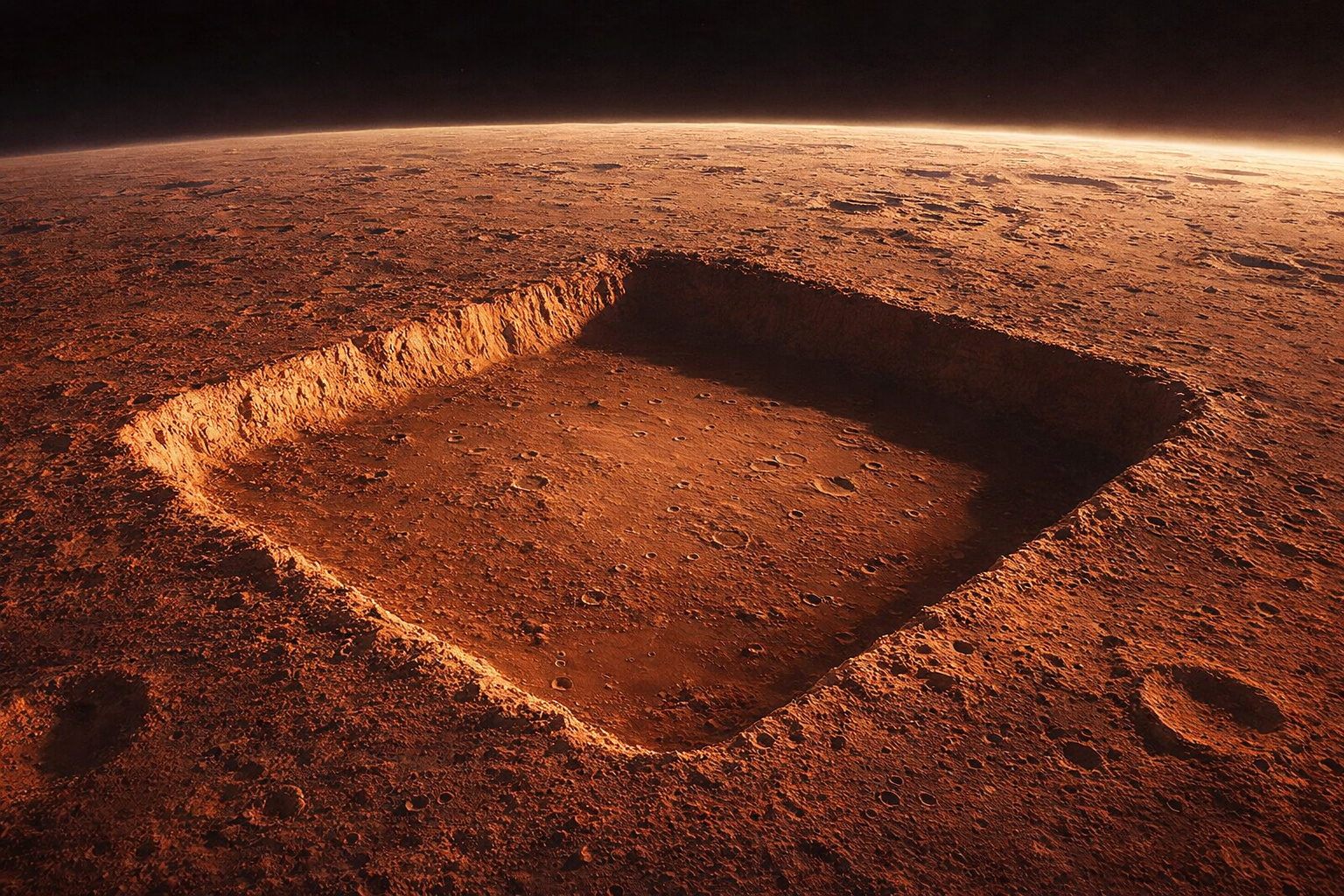

La NASA fotografió un cuadrado casi perfecto de 3 km de lado en Marte, 13 veces más grande que la pirámide de Keops, pero la explicación oficial es erosión natural; aun así, nadie ha explicado por qué los cuatro lados tienen una longitud casi idéntica.

-

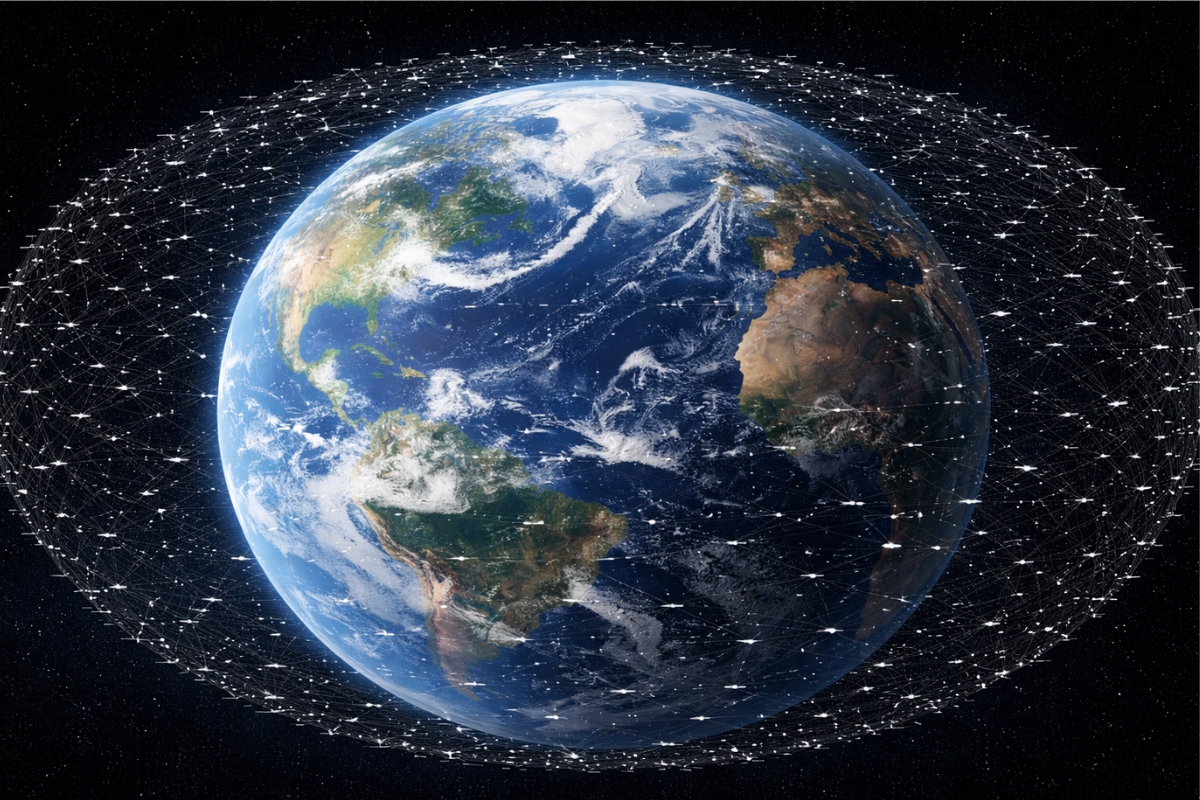

Starlink rompe la barrera de los 10,000 satélites en órbita y lleva su expansión a un nivel sin precedentes, con impacto directo en la internet global, en la competencia tecnológica y en la disputa por el espacio.

-

Japón encuentra una alternativa al petróleo en plena subida de precios al transformar el balance del océano en electricidad con una nueva tecnología que mantiene la eficiencia incluso cuando el mar cambia.

Por un lado, el gobierno de Donald Trump busca ampliar el acceso de las Fuerzas Armadas a herramientas de este tipo.

Por otro, las empresas de tecnología mantienen restricciones para usos vinculados a la vigilancia masiva y a sistemas autónomos con potencial letal.

Alerta de China sobre uso militar de la inteligencia artificial

Al comentar la posibilidad de mayor apertura para el uso militar de la inteligencia artificial por parte de Estados Unidos, Jiang Bin dijo que permitir la influencia excesiva de algoritmos en decisiones de guerra compromete principios éticos y responsabilidades asociadas a conflictos armados.

Según él, el uso de la tecnología sin un control adecuado puede provocar pérdida de control técnico en escenarios militares.

En la misma declaración, el portavoz recurrió a la referencia cinematográfica que dio repercusión al caso.

“Una distopía como la retratada en la película estadounidense ‘Terminator’ puede un día hacerse realidad”, afirmó.

La declaración fue divulgada en respuesta a cuestionamientos sobre la disposición de Washington a ampliar el acceso del Ejército estadounidense a la IA.

Además, Jiang Bin afirmó que la militarización de la inteligencia artificial puede ser usada para violar la soberanía de otros países e influir de manera indebida en decisiones relacionadas con la guerra.

La posición expuesta por el gobierno chino es que sistemas de este tipo no deben reemplazar la actuación humana en deliberaciones que involucren vida y muerte.

Lanzado en 1984 y protagonizado por Arnold Schwarzenegger, “Terminator” retrata un futuro en el que máquinas controladas por una inteligencia artificial entran en guerra contra los humanos.

La mención a la película fue utilizada por Pekín para reforzar públicamente los riesgos que, según el gobierno chino, rodean el avance de sistemas autónomos en el campo militar.

Pentágono, Anthropic y restricciones a la IA generativa

En el centro de la controversia está Anthropic, la empresa responsable del asistente de IA generativa Claude.

La compañía comenzó a enfrentar restricciones del Departamento de Defensa de Estados Unidos tras mantener limitaciones para determinados usos militares de sus sistemas.

En posicionamientos públicos, la empresa afirmó que no autoriza el uso de sus modelos para vigilancia masiva y también se opone al empleo de la tecnología en armas totalmente autónomas.

Anthropic sostiene que este tipo de aplicación requiere salvaguardias más estrictas y supervisión humana.

La reacción del Pentágono elevó el conflicto.

El Departamento de Defensa clasificó a la empresa como riesgo de cadena de suministro, lo que restringió el uso de sus herramientas en contratos vinculados a la cartera.

La medida afectó a Claude y amplió el debate sobre quién debe establecer los límites para el uso militar de la inteligencia artificial en los Estados Unidos.

El episodio también expuso una divergencia dentro del propio sector de tecnología estadounidense.

Mientras el gobierno defiende mayor flexibilidad para el uso de estas herramientas en el área de defensa, parte de las empresas argumenta que hay riesgos operacionales y éticos en aplicaciones sin restricciones claras.

Ofensiva contra Irán y dudas sobre el papel de la IA

La controversia ganó aún más atención tras relatos de que herramientas de Anthropic habrían sido usadas por Estados Unidos en la ofensiva contra Irán.

Las informaciones disponibles, sin embargo, no detallan de forma concluyente cómo estos sistemas habrían sido empleados ni cuál fue su función específica en las operaciones.

Este punto amplió el debate porque llevó la discusión más allá del campo teórico.

En lugar de limitarse a principios generales sobre inteligencia artificial y guerra, el caso pasó a involucrar una situación concreta de posible uso de la tecnología en un entorno militar.

Al mismo tiempo, la ausencia de detalles técnicos públicos impide conclusiones más amplias sobre el papel exacto de estos sistemas.

Por eso, el tema sigue rodeado de cuestionamientos sobre transparencia, supervisión y responsabilidad en el uso de herramientas de IA en operaciones de defensa.

Disputa entre China y Estados Unidos por inteligencia artificial

La declaración de Jiang Bin también se inscribe en una disputa tecnológica más amplia entre China y Estados Unidos.

La inteligencia artificial se ha convertido en uno de los ejes centrales de la competencia entre las dos potencias, tanto en el campo económico como en el área militar.

En este contexto, China ha buscado presentarse como defensora de límites más estrictos para el uso militar de la tecnología, al mismo tiempo en que critica la política estadounidense para el sector.

Estados Unidos, por su parte, enfrenta un debate interno que involucra al gobierno, empresas de tecnología y expertos en ética digital.

La controversia en torno a Anthropic ayuda a mostrar que la discusión no se restringe a un enfrentamiento entre países.

También implica desacuerdos dentro de la propia industria estadounidense sobre hasta dónde puede avanzar la inteligencia artificial en decisiones militares sin comprometer mecanismos de control humano.

La referencia a “Terminator”, en este escenario, sirvió como un recurso de lenguaje para traducir un temor que ha sido discutido por autoridades, empresas y expertos: el de que sistemas automatizados comiencen a ocupar un espacio cada vez mayor en decisiones sensibles de guerra antes de que existan reglas consolidadas para ese uso.

En el centro de la disputa está precisamente la definición de esos límites.

Por un lado, los gobiernos argumentan que la inteligencia artificial puede ampliar la capacidad operativa y la respuesta militar.

Por otro, empresas y analistas alertan sobre los riesgos de delegar funciones críticas a sistemas que aún plantean dudas sobre seguridad, control y responsabilidad.

Debate sobre control humano en decisiones de guerra

La discusión entre Washington, Anthropic y Pekín muestra que la inteligencia artificial aplicada a la defensa ha dejado de ser solo un tema prospectivo.

Ya forma parte de la agenda de seguridad de grandes potencias y ha comenzado a movilizar disputas políticas, empresariales y diplomáticas.

Con esto, el debate sobre el uso de la IA en áreas militares tiende a ganar aún más espacio.

La cuestión central sigue siendo el grado de control humano que debe ser mantenido cuando la tecnología comienza a interferir en etapas decisivas de operaciones de guerra.

-

-

-

3 pessoas reagiram a isso.