Estudio Revela Que Modelos De IA Más Complejos Emiten Mucho Más CO₂, Incluso Cuando No Ofrecen Respuestas Más Precisos En Las Tareas

El uso de herramientas de IA se ha vuelto común en el día a día de millones de personas. En Estados Unidos, alrededor del 52% de los adultos utilizan regularmente modelos de lenguaje de gran tamaño, también conocidos como LLMs. Sin embargo, un nuevo estudio realizado por investigadores de la Universidad de Ciencias Aplicadas de Múnich, en Alemania, plantea una advertencia: este uso tiene un alto costo ambiental.

Cómo Se Realizaron Las Pruebas

Los científicos analizaron 14 modelos diferentes, con niveles variados de complejidad. El equipo aplicó 1.000 preguntas iguales a todos los modelos y midió cuántos “tokens” cada uno generó.

Tokens son unidades de texto procesadas por el sistema. Cuantos más tokens, más procesamiento, más energía consumida — y, por consecuencia, más emisión de gases de efecto invernadero.

-

Mercor pagó 1,5 millones de dólares por día para que médicos, abogados y ex-banquero de Goldman Sachs enseñaran a la inteligencia artificial a hacer su trabajo y, en 17 meses, pasó de cero a 500 millones de dólares en ingresos anuales mientras sus propios contratados aceleran la sustitución de su propio trabajo.

-

Casio presenta a Moflin, una mascota robótica con inteligencia artificial creada para ofrecer confort emocional y simular un vínculo afectivo permanente.

-

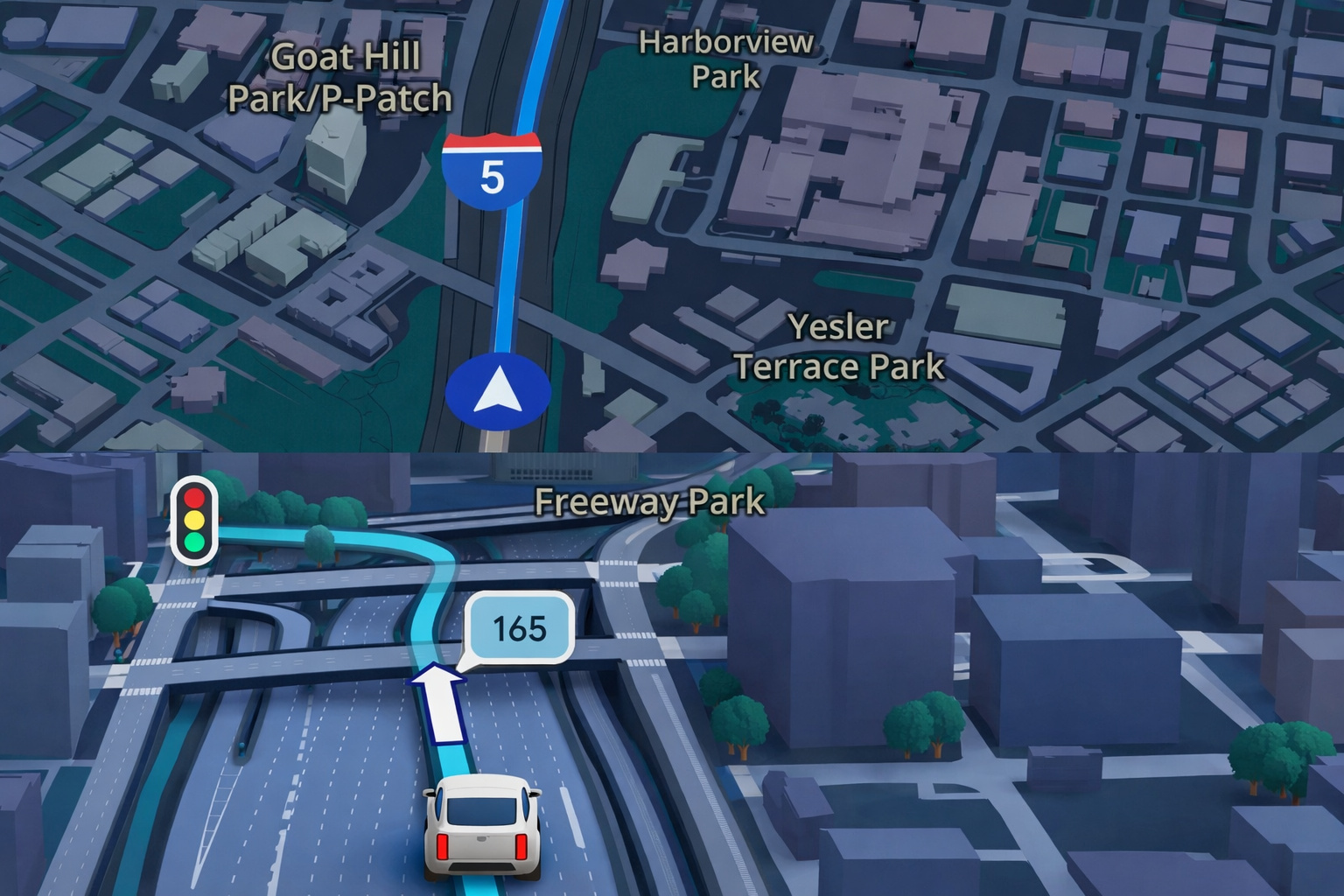

Google Maps revoluciona la navegación por GPS con la inteligencia artificial Gemini, la función Ask Maps y visualización 3D avanzada para la planificación de rutas y viajes

-

China advierte a EE. UU. sobre un apocalipsis estilo «Terminator»: la disputa por la inteligencia artificial militar, las sanciones contra una startup estadounidense y el miedo a que los algoritmos decidan quién vive o muere ponen al mundo ante una pesadilla que parecía solo ficción

Las pruebas se realizaron en computadoras con GPU NVIDIA A100, utilizando la estructura Perun, que mide el consumo de energía de los LLMs. Se utilizó un factor medio de emisión de 480 gramos de CO₂ por kilovatio-hora.

Las preguntas cubrían temas como filosofía, historia, derecho, álgebra y matemáticas de educación secundaria. Los modelos analizados incluían sistemas de Meta, Alibaba, Deep Cognito y Deepseek.

Las Emisiones Varían Según El Tipo De Modelo

La conclusión fue clara: los modelos con razonamiento avanzado generaron muchas más emisiones que los modelos de respuesta directa. En promedio, los LLMs de razonamiento produjeron 543,5 tokens por pregunta.

Los modelos de texto simple apenas generaron 37,7 tokens. Más tokens significan más consumo de energía — pero eso no garantiza más precisión.

El modelo más preciso de la investigación fue el Deep Cogito 70B, que acertó el 84,9% de las preguntas. Pero también emitió tres veces más CO₂ que modelos del mismo tamaño que dieron respuestas más simples.

Por otro lado, el modelo que más contaminó fue el Deepseek R1 70B. Generó 2.042 gramos de CO₂ por 1.000 preguntas. Esto equivale a la emisión de un viaje en coche de 15 kilómetros. Con 600 mil preguntas, ese mismo modelo produciría emisiones similares a un vuelo entre Londres y Nueva York. Su tasa de acierto fue del 78,9%.

El más eficiente en términos de energía fue el Qwen 7B de Alibaba. Emitió solo 27,7 gramos de CO₂, pero su precisión fue del 31,9%.

La Complejidad Aumenta El Costo

El estudio mostró que los modelos con más razonamiento lógico no solo generan más tokens, sino que también tienen dificultad para responder de manera objetiva.

A pesar de recibir instrucciones para responder solo con la letra correcta, algunos modelos generaron miles de tokens. En una única pregunta matemática, el Deepseek-R1 7B llegó a generar más de 14 mil tokens.

El área del conocimiento también influye en el consumo. Las preguntas sobre álgebra abstracta y filosofía requirieron más razonamiento y, por lo tanto, más energía.

Modelos Famosos Quedaron Fuera

El estudio no analizó los LLMs más conocidos por el público, como ChatGPT, Gemini, Grok o Claude. La investigación se centró en modelos accesibles para el grupo de científicos y que pudieran ser probados en condiciones controladas.

Aun así, los resultados encienden una alerta importante sobre el futuro de la IA y su costo ambiental.

Las Elecciones Pueden Reducir El Impacto

Según los autores del estudio, entender cómo cada modelo consume energía es esencial para el uso responsable de la IA. Los usuarios pueden ayudar reduciendo el número de preguntas largas o evitando el uso de modelos pesados para tareas simples.

Maximilian Dauner, principal autor de la investigación, refuerza este punto. “Los usuarios pueden reducir significativamente las emisiones solicitando respuestas concisas o limitando el uso de modelos de alta capacidad a tareas que realmente exijan esa capacidad”, dijo.

El estudio también sugiere que informar al usuario sobre el costo ambiental de cada pregunta puede hacer que el uso de la tecnología sea más consciente y sostenible.

Con información de New Atlas.

Portugués

Portugués  Inglés

Inglés  Español

Español

Seja o primeiro a reagir!