Investigadores de Toyota muestran que los robots pueden aprender tareas al observar a los humanos, superando uno de los mayores desafíos de la robótica moderna.

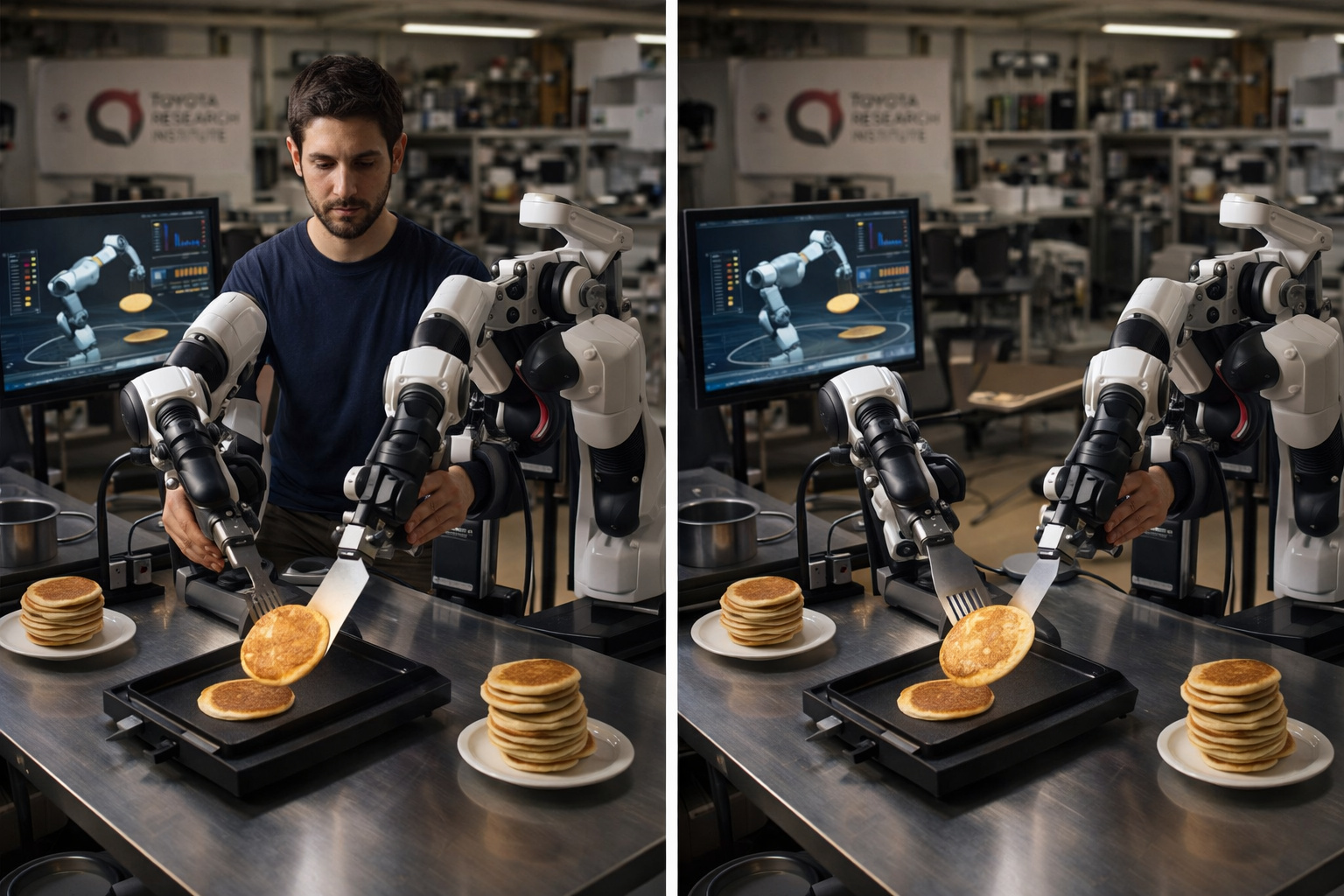

En un laboratorio en Cambridge, Massachusetts, lleno de brazos robóticos, computadoras y una colección aleatoria de objetos cotidianos — palas, batidores de huevos, tazones — investigadores del Toyota Research Institute pasan las tardes haciendo algo que parece absurdo a primera vista: voltear panqueques.

No son ellos quienes voltean. Es un operador humano controlando un brazo robótico a través de un dispositivo háptico — un sistema que transmite de vuelta la sensación de toque y resistencia, para que el operador sienta el peso de la espátula, la resistencia de la masa, el momento justo para voltear. El movimiento se repite alrededor de 300 veces en una sola tarde. El modelo de IA procesa estos datos durante la noche. A la mañana siguiente, el robot a menudo puede voltear panqueques por sí solo.

Es el método llamado teleoperación, y el TRI — el brazo de investigación del grupo Toyota — publicó en septiembre de 2023 los resultados de un enfoque que él mismo llamó avance: usando inteligencia artificial generativa aplicada al proceso de demostración, la institución enseñó más de 60 habilidades diferentes al mismo robot, con el mismo código y el mismo hardware. Pelar vegetales, usar batidora, preparar bocadillos, doblar paños — todo aprendido en una tarde.

-

Adiós plancha: un artículo común en los hogares comienza a perder espacio frente a la tecnología que alisa la ropa en minutos sin tabla y con menos consumo de energía.

-

Antártida revela una pista inusual en lo alto de las montañas Hudson, y lo que parecía ser solo una roca aislada comenzó a exponer un secreto guardado bajo el hielo durante eras.

-

Salarios de hasta R$ 25 mil, escasez de profesionales y demanda explotando en 2026 hacen del especialista en automatización no-code una de las carreras más disputadas de Brasil, incluso sin exigir un diploma o saber programar.

-

La primera fábrica de ladrillos a escala comercial impulsada por hidrógeno va a nacer.

Por qué un robot necesita 300 panqueques para aprender

Para entender lo que el TRI está haciendo en Cambridge, es necesario entender el problema que está tratando de resolver. Cuando OpenAI entrenó a ChatGPT, el combustible era texto — billones de palabras producidas por humanos a lo largo de décadas, disponibles para descargar en servidores de todo el mundo. Los modelos de lenguaje bebieron de un océano que ya existía.

Los robots no tienen ese océano. No existe un equivalente físico de internet. No hay una base de datos con miles de millones de ejemplos de cómo un humano voltea un panqueque sin romper la masa, pela un pepino sin resbalar, o pasa un trapo mojado sobre una superficie irregular sin dejar agua acumulada en la esquina.

Sin datos, no hay aprendizaje — y en el mundo físico son raros

Estos datos necesitan ser creados — movimiento por movimiento, en entornos reales, con robots reales, por operadores humanos entrenados. Es un proceso costoso, lento y físicamente exigente. Y es exactamente este cuello de botella el que está frenando el avance de la robótica moderna.

Según un informe de MIT Technology Review de abril de 2024, la escasez de datos físicos de alta calidad es una de las principales razones por las cuales los robots aún operan en entornos estrictamente controlados y fallan al enfrentar variaciones mínimas del mundo real. Un robot entrenado para recoger una manzana roja en una mesa específica puede no ser capaz de recoger la misma manzana si está ligeramente inclinada, o sobre una superficie diferente, o con iluminación distinta.

Lo que sucede cuando se usa el cuerpo para enseñar

El método del TRI tiene un nombre técnico — Diffusion Policy — pero la lógica es intuitiva. Un operador humano se sienta frente a un dispositivo háptico bimano: dos controladores que reflejan los movimientos de las manos y transmiten de vuelta resistencia física. El robot al lado replica cada gesto en tiempo real. El operador siente lo que el robot siente — la presión de la espátula en la masa, la resistencia del mango de una batidora, el peso de un vaso lleno.

Esta conexión física es fundamental. Sin ella, el robot aprendería solo la trayectoria geométrica del movimiento — el arco de la espátula en el aire, el ángulo de entrada en el panqueque. Con ella, también aprende la fuerza necesaria, el momento de ajuste, la respuesta al objeto. Es la diferencia entre un robot que sabe dónde mover el brazo y un robot que sabe cómo.

Cómo los humanos transfieren habilidad

El operador repite la tarea decenas o cientos de veces. Cada iteración es ligeramente diferente — el panqueque está en un ángulo diferente, la sartén está en una posición ligeramente distinta, la masa tiene textura variable. Esta diversidad es intencional: cuanto más variaciones ve el modelo, mejor generaliza para situaciones nuevas.

Según el propio TRI, el modelo procesa los datos durante la noche usando el algoritmo de Diffusion Policy — un enfoque de IA generativa que aprende a «difundir» patrones de movimiento a partir de las demostraciones. A la mañana siguiente, el robot ejecuta la tarea de forma autónoma, a menudo sin una sola línea de código nueva. La única cosa que cambió fue el dato.

Sesenta habilidades sin escribir una línea de código

El resultado más impresionante del programa del TRI no es el panqueque. Es la escala. Usando exactamente el mismo robot, el mismo código y la misma configuración de laboratorio, los investigadores enseñaron más de 60 habilidades distintas — todo lo que requiere manipulación fina de objetos cotidianos que tradicionalmente desafía a los robots.

Pelar vegetales implica lidiar con superficies orgánicas irregulares y presión variable. Usar una batidora manual requiere coordinar dos brazos con un tiempo preciso. Manipular objetos blandos como paños o masa de pan es particularmente difícil porque el objeto cambia de forma a medida que se toca — y el robot necesita ajustar el gesto en tiempo real.

Según la declaración de Gill Pratt, CEO del TRI y científico jefe de Toyota, publicada en septiembre de 2023: «Esta nueva técnica de enseñanza es a la vez muy eficiente y produce comportamientos de alto rendimiento.» El TRI estableció una meta interna ambiciosa poco después del anuncio: enseñar cientos de nuevas habilidades hasta finales de 2023 y mil habilidades hasta finales de 2024.

El problema que el panqueque no resuelve

El método funciona. El problema es que no escala. Cada nueva habilidad requiere uno o dos operadores humanos, uno o dos brazos robóticos, de una a dos horas de demostraciones, procesamiento computacional durante la noche y validación a la mañana siguiente. Para enseñar mil habilidades, se necesitan suficientes operadores humanos, suficientes robots y suficiente tiempo. Para enseñar un millón de habilidades — el número que los investigadores estiman necesario para un robot verdaderamente de uso general — la cuenta no cierra.

MIT Technology Review describió con precisión el paradoja: crear datos de teleoperación de alta calidad «lleva mucho tiempo y está limitado por el número de robots caros que se pueden comprar». La escasez es doble — de tiempo humano y de hardware. Es exactamente por eso que la industria está buscando atajos en múltiples direcciones simultáneamente.

La carrera por datos que está transformando la investigación

La respuesta de la comunidad científica al cuello de botella de datos ha sido crear un esfuerzo colectivo sin precedentes en la historia de la robótica. El proyecto DROID — Distributed Robot Interaction Dataset — reunió a 13 instituciones, incluyendo Stanford, Carnegie Mellon, UC Berkeley, Google DeepMind y el propio Toyota Research Institute.

Durante 12 meses, 50 recolectores de datos recorrieron tres continentes con 18 robots, reuniendo datos en 564 escenarios diferentes, 86 tareas distintas y 52 edificios. El resultado: 76 mil trayectorias de demostración, equivalentes a 350 horas de datos de interacción — la mayor base de datos pública de manipulación robótica del mundo hasta entonces.

Recolectar datos se ha convertido en la nueva frontera de la robótica

El conjunto de datos fue lanzado como código abierto para que cualquier laboratorio pudiera utilizarlo y expandirlo. Uno de los organizadores, el investigador Karl Pertsch de UC Berkeley, describió la velocidad de la recolección como notable. Según un informe de IBM de diciembre de 2025, afirmó que «en 2023, los mayores conjuntos de datos de robots utilizados en investigación eran del orden de algunas decenas de horas. El Open X-Embodiment contiene alrededor de 2.000 horas y fue montado en cuestión de meses».

Pero 350 horas o incluso 2.000 horas son una fracción minúscula de lo que sería necesario para entrenar robots al nivel de generalización de los modelos de lenguaje. Estimaciones citadas por MIT Technology Review apuntan a que, al ritmo actual de recolección manual, serían necesarios alrededor de 100.000 años para acumular datos físicos equivalentes a los que alimentaron a ChatGPT.

Los atajos que la industria está probando

Ante la imposibilidad de recolectar todo manualmente, la industria está desarrollando métodos alternativos en paralelo. El primero es aprender a partir de videos. Meta AI montó el proyecto Ego4D — más de 3.700 horas de videos en primera persona de personas alrededor del mundo haciendo de todo, desde colocar ladrillos hasta amasar masa de pan. El problema: el video no captura datos cinestésicos — la posición exacta del brazo robótico en el espacio, la fuerza aplicada, la resistencia del objeto. Es un acercamiento útil, pero incompleto.

El segundo es simulación. Nvidia desarrolló la plataforma Cosmos, capaz de tomar algunas decenas de horas de datos reales y crear entornos sintéticos en 3D — diferentes distribuciones de cocina, diferentes alturas de mesa, diferentes objetos en la misma posición. En lugar de recolectar datos para 500 configuraciones diferentes de panqueque, se simula digitalmente lo que sucedería en cada una. La «brecha de realidad» — la diferencia entre lo que el robot aprendió en la simulación y lo que encuentra en el mundo real — sigue siendo un problema abierto, pero está disminuyendo.

Video, simulación y RA: alternativas al aprendizaje manual

El tercero es realidad aumentada. Investigadores de la Universidad de Washington y Nvidia desarrollaron una aplicación móvil que permite a cualquier persona entrenar robots simplemente grabando videos de sí misma haciendo tareas simples con las manos — tomar una taza, abrir un cajón. El programa de RA convierte los movimientos en puntos de trayectoria que el robot puede seguir. Es más fácil de recolectar, pero menos preciso que la teleoperación háptica.

Ninguno de estos métodos resuelve el problema completamente. La teleoperación háptica del TRI aún produce los datos de mayor calidad — los más ricos en información física, los que generan robots con mejor rendimiento en tareas complejas. El costo de crearlos sigue siendo alto.

Atlas aprende a doblar toallas con el TRI

En agosto de 2025, el Toyota Research Institute y Boston Dynamics anunciaron los resultados de una colaboración de investigación iniciada en octubre de 2024: el robot humanoide Atlas ejecutando una larga y continua secuencia de tareas complejas a partir de un Large Behavior Model — el equivalente físico de un Large Language Model.

En el video conjunto divulgado por ambas organizaciones, el Atlas utiliza movimientos de cuerpo completo — caminar, agacharse, levantar — para realizar una serie de tareas de empaquetado, clasificación y organización. Durante la ejecución, los investigadores introducen obstáculos inesperados — cierran la tapa de una caja en medio del proceso, deslizan la caja por el suelo — y el robot se ajusta sin instrucción adicional.

El método detrás es exactamente el del TRI: operadores humanos con auriculares de VR y rastreadores en las manos, pies y torso controlan el Atlas por teleoperación, reflejando sus movimientos al robot. Las cámaras del robot transmiten visión estereoscópica; el feedback háptico permite al operador sentir lo que el robot toca. Cada sesión genera un conjunto de datos rico que alimenta el entrenamiento del Large Behavior Model.

Scott Kuindersma, vicepresidente de investigación en robótica de Boston Dynamics, fue directo: «Entrenar una única red neuronal para realizar muchas tareas a largo plazo llevará a una mejor generalización, y robots altamente capaces como el Atlas presentan las menores barreras para la recolección de datos.»

Lo que viene después del panqueque

El Toyota Research Institute definió su objetivo públicamente: construir robots que amplíen las capacidades humanas, no que las reemplacen. La frase del CEO Gill Pratt es recurrente en los comunicados de la institución — «nuestra investigación en robótica tiene como objetivo ampliar a las personas, no sustituirlas».

En la práctica, el horizonte inmediato es la asistencia doméstica para ancianos — una prioridad estratégica de Japón, donde la población envejece rápidamente y hay una creciente escasez de cuidadores. Un robot capaz de preparar un desayuno simple, recoger medicamentos de un armario o doblar una prenda de ropa tiene un impacto concreto medible en este contexto.

El horizonte a medio plazo es lo que el sector llama Large Behavior Model: un modelo capaz de recibir una instrucción en lenguaje natural — «prepara el desayuno» — y descomponer autónomamente esa instrucción en cientos de micro-tareas físicas, adaptando cada una al entorno específico encontrado en la cocina de ese día. Para llegar allí, el panqueque aún necesita ser volteado muchas veces.

Por qué el cuello de botella de datos es más difícil de lo que parece

La escasez de datos físicos no es solo un problema de volumen. Es un problema de diversidad, consistencia y transferibilidad. Un modelo de lenguaje entrenado en textos en inglés puede generalizar a estructuras de frase nunca vistas antes porque el lenguaje tiene patrones universales — gramática, semántica, contexto. Un robot entrenado para voltear panqueques en sartenes antiadherentes de 25 cm no generaliza automáticamente a sartenes de acero inoxidable de 30 cm. El mundo físico es mucho más variable que el lenguaje.

Esto significa que cada nueva variable — un nuevo objeto, una nueva superficie, un nuevo entorno — requiere datos nuevos. Y cada conjunto de datos nuevos requiere nuevos operadores humanos, nuevos robots y nuevo tiempo.

El problema no es solo cantidad, es variabilidad

Scale AI, empresa de infraestructura de datos que alimenta los principales modelos de lenguaje del mundo, entró en el sector de robótica en 2025 con un producto llamado Physical AI Data Engine. En pocos meses, había recolectado más de 100.000 horas de datos robóticos reales. Un número robusto — pero aún una fracción de lo que la industria necesita.

«Hoy, los modelos de robots de código abierto más generalizables están entrenados en DROID», dijo Karl Pertsch, investigador de UC Berkeley. Lo que no dijo es que 350 horas de datos, por más alta que sea la calidad, sigue siendo una gota comparada con el océano de texto que entrenó a los modelos de lenguaje.

El estado actual de la robótica — y lo que aún falta

Los robots humanoides en 2025 y 2026 operan dentro de límites bien definidos. El Digit, de Agility Robotics, trabaja en depósitos de Amazon en áreas separadas de los humanos por barreras físicas. El Figure 02 realiza inserción de chapas metálicas en BMW con precisión milimétrica, pero en tareas estrechamente especificadas. El Atlas, a pesar de los avances recientes, aún se prueba en entornos controlados antes de cualquier interacción con trabajadores humanos.

La batería sigue siendo un problema: el Digit opera durante 90 minutos antes de una recarga de 9 minutos, y en la práctica funciona en bloques de 30 minutos en los depósitos de Amazon. El Figure 02 aguanta de 2 a 3 horas. Ningún humanoide comercial sostiene un turno completo de 8 horas sin interrupción.

La seguridad es otro cuello de botella regulatorio: a diferencia de un brazo industrial que se detiene cuando se presiona el botón rojo, un robot humanoide bípedo no puede ser simplemente apagado — se cae. Aún no existe un estándar ISO para robots con equilibrio dinámico. Boston Dynamics y el TRI están contribuyendo al desarrollo de estas normas, pero están a años de ser finalizadas.

Al final, todo vuelve al mismo problema: datos

Lo que todo esto tiene en común es el problema de los datos. Cada limitación — la batería, la seguridad, la generalización — tiene, en el fondo, un componente de datos insuficientes. Más datos de operación en campo significan baterías mejor gestionadas. Más datos de interacción humano-robot significan protocolos de seguridad más robustos. Más datos de tareas variadas significan robots que generalizan en lugar de bloquearse.

El panqueque volteado 300 veces en una tarde en Cambridge es, en este sentido, más que un experimento curioso. Es la versión actual de lo que la industria de robótica tiene de mejor — y también la demostración más directa del camino que aún necesita ser recorrido.

Seja o primeiro a reagir!