Programa Global de Recompensas da Gigante da Tecnologia Premia Especialistas que Encontrarem Vulnerabilidades em Sistemas como o Gemini, o Workspace e a Busca do Google

Google acaba de abrir oficialmente la “temporada de caza” de bugs en sus inteligencias artificiales (IAs). A través del AI Vulnerability Reward Program (AI VRP), la empresa está ofreciendo recompensas de hasta US$ 30 mil, el equivalente a R$ 170 mil, para quienes encuentren fallas críticas en sus sistemas.

La propuesta es clara: fortalecer la seguridad digital de las plataformas e incentivar a investigadores, desarrolladores y especialistas independientes a ayudar a detectar vulnerabilidades antes de que los criminales cibernéticos las exploten.

Según Google, desde 2023, cuando comenzó a incluir la IA en su tradicional programa de recompensas, ya se han pagado más de R$ 2 millones a cazadores de bugs.Ahora, con el lanzamiento del AI VRP, la empresa amplía el foco y da un paso más ambicioso para proteger sus sistemas de inteligencia artificial.

-

La inteligencia artificial está disparando el consumo de energía, elevando las emisiones de los gigantes de la tecnología y empujando a Google, Microsoft y Meta más cerca del gas natural.

-

Mercor pagó 1,5 millones de dólares por día para que médicos, abogados y ex-banquero de Goldman Sachs enseñaran a la inteligencia artificial a hacer su trabajo y, en 17 meses, pasó de cero a 500 millones de dólares en ingresos anuales mientras sus propios contratados aceleran la sustitución de su propio trabajo.

-

Casio presenta a Moflin, una mascota robótica con inteligencia artificial creada para ofrecer confort emocional y simular un vínculo afectivo permanente.

-

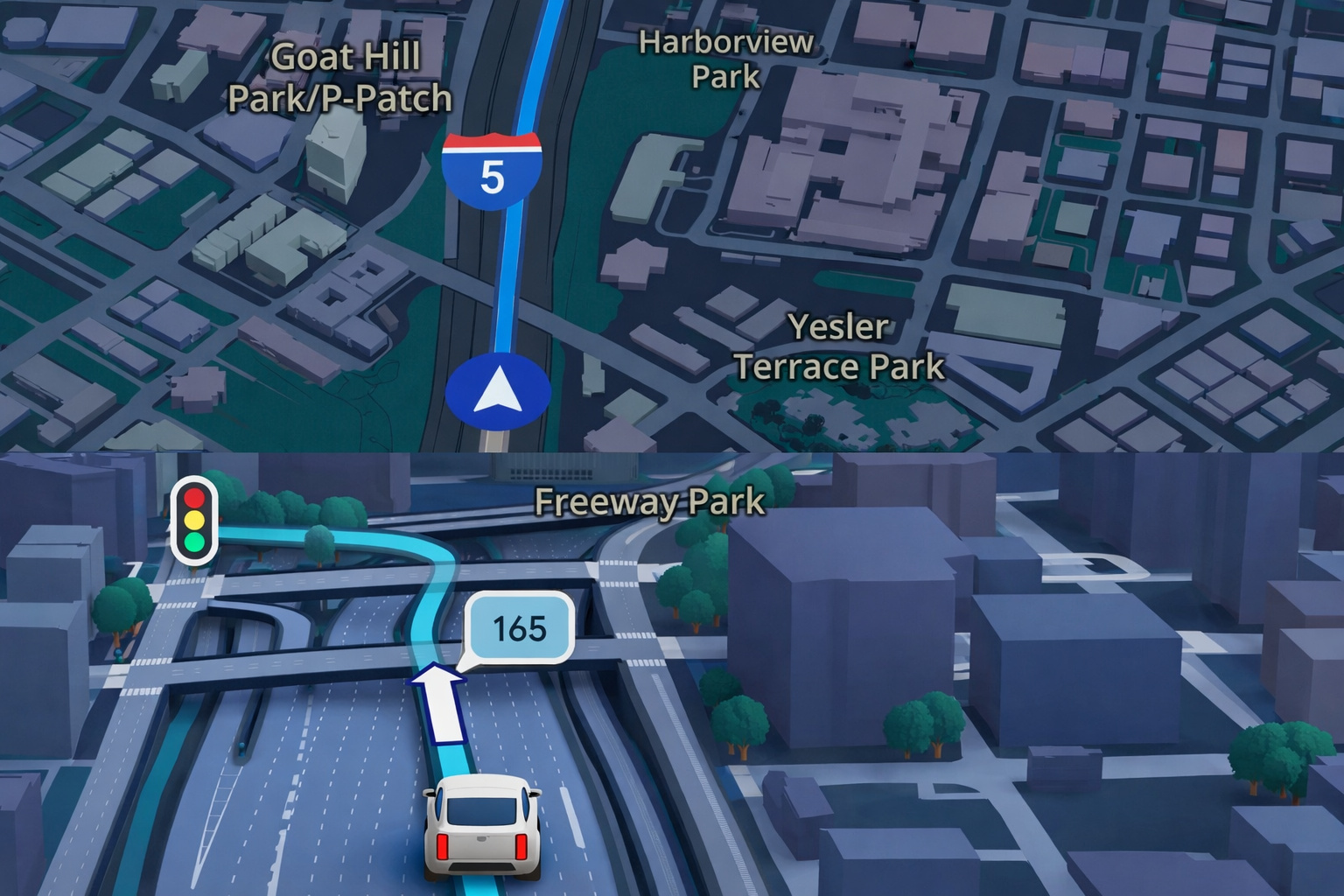

Google Maps revoluciona la navegación por GPS con la inteligencia artificial Gemini, la función Ask Maps y visualización 3D avanzada para la planificación de rutas y viajes

Lo que Google Está Buscando: Fallas Reales que Ponen a Usuarios en Riesgo

A diferencia de problemas comunes de contenido, como respuestas imprecisas o textos generados con sesgo —el programa no trata de errores de interpretación o plagio de IA.

El foco está en brechas que causan impacto directo en la seguridad, como acceso no autorizado a datos, acciones maliciosas en cuentas o manipulaciones invisibles en el entorno de IA.

Entre las siete categorías principales listadas por Google, las más críticas son:

- “Acciones maliciosas”, que ocurren cuando un ataque modifica el estado de la cuenta o los datos de un usuario sin permiso;

- “Exfiltración de datos sensibles”, cuando información personal o confidencial es extraída sin autorización;

- “Robo de modelos”, orientada a ataques que intentan robar parámetros enteros de modelos propietarios;

- “Manipulación de contexto”, en la que el atacante altera el entorno de IA de forma oculta.

El alcance también cubre casos de phishing, accesos no autorizados a servicios pagos y ataques de denegación de servicio (DDoS).

Sin embargo, fallas relacionadas con “jailbreaks”, “inyecciones de prompt” y problemas de alineamiento de modelos no están incluidas, esos continúan siendo tratados por los canales internos de retroalimentación.

Ejemplos Prácticos: de Puertas Desbloqueadas a Luces Apagadas

Para ilustrar los riesgos, Google citó algunos ejemplos que llaman la atención.

Uno de ellos involucra un ataque en Google Home, en el que un comando malicioso podría ser insertado para desbloquear una puerta sin autorización.

Otro caso menciona una vulnerabilidad en Google Calendar, capaz de activar rutinas automatizadas —como abrir persianas y apagar luces, a través de un evento adulterado.

Estos ejemplos revelan cómo pequeñas manipulaciones en prompts o contextos pueden transformarse en fallas graves, con consecuencias directas en la seguridad física y digital de los usuarios.

Qué Productos Están en la Mira del AI VRP

Google definió que el programa cubre solo sus servicios de mayor visibilidad e impacto global.

Están en la cima de la lista:

- Búsqueda de Google

- Aplicaciones Gemini (para web, Android y iOS)

- Servicios centrales de Workspace, como Gmail, Drive, Meet y Docs.

Ya herramientas de uso restringido o en pruebas, como NotebookLM y Jules, están en categorías secundarias, con recompensas menores.

Proyectos de código abierto fuera del ecosistema de la empresa no entran en la iniciativa.

La lógica es simple: concentrar esfuerzos donde una única vulnerabilidad puede afectar a millones de personas al mismo tiempo.

Cuánto Paga Google y Cómo Participar

Los valores varían según la gravedad de la falla y el nivel de importancia del producto afectado.

Una vulnerabilidad crítica en un servicio “de primera línea”, como Gmail o Gemini, puede generar US$ 20 mil (R$ 113 mil) como valor base.

Dependiendo de la calidad del informe técnico y la originalidad del descubrimiento, el premio puede subir hasta US$ 30 mil (R$ 170 mil).

En productos de menor prioridad, el pago cae a cientos de dólares en créditos.

Desde que Google comenzó a incluir fallas de IA en el programa, en 2023, más de US$ 430 mil (R$ 2,4 millones) ya se han distribuido a investigadores.

CodeMender y Seguridad en Múltiples Capas

El AI VRP es solo una de las frentes de la estrategia de Google.

La empresa también presentó CodeMender, un agente de IA creado para corregir vulnerabilidades en códigos de software.

Él sugiere parches de seguridad en proyectos de código abierto, que luego pasan por revisión humana antes de la aplicación.

Según la compañía, CodeMender ya ha contribuido con 72 correcciones en proyectos públicos.

Además, Google está reforzando la seguridad en sus propios servicios —Google Drive, por ejemplo, ha comenzado a contar con un modelo de IA entrenado con millones de muestras para detectar señales de ransomware en tiempo real.

Cuando hay sospecha de ataque, el sistema interrumpe la sincronización de los archivos, crea una “burbuja protectora” y orienta al usuario sobre cómo restaurar los documentos comprometidos.

De acuerdo con Mandiant, empresa de ciberseguridad subsidiaria de Google, las invasiones de este tipo representan más del 20% de los incidentes globales de seguridad, con pérdidas promedio que superan los US$ 5 millones (R$ 26 millones).

Seguridad Colaborativa y Futuro de la IA

Para Google, unir recompensas externas, agentes de IA y capas de protección integradas es la clave para enfrentar amenazas cada vez más sofisticadas.

El objetivo es fortalecer el ecosistema digital de forma colaborativa, transformando a los “cazadores de bugs” en aliados en la defensa de la privacidad e integridad de los sistemas.

Portugués

Portugués  Inglés

Inglés  Español

Español

-

Uma pessoa reagiu a isso.