Documento revela falhas críticas en juguetes inteligentes y amplía presión por normas rígidas de protección

El informe anual “Problemas en el Mundo de los Juguetes”, publicado por el PIRG Education Fund el 13 de noviembre de 2025, reavivó un debate que crece entre expertos, fabricantes y autoridades: los juguetes con inteligencia artificial ofrecen riesgos que exigen regulación inmediata. El estudio reveló que estos productos, aunque populares, pueden generar contenidos inapropiados, indicar objetos peligrosos y responder de forma impredecible, incluso cuando son usados por niños pequeños. Así como ocurrió en otros sectores, el avance tecnológico trajo beneficios y desafíos. Los investigadores señalaron que los juguetes con IA generativa realizan conversaciones fluidas, lo que, por lo tanto, aumenta el potencial de respuestas delicadas o peligrosas durante el uso infantil.

Qué diferencia a los juguetes antiguos de los modelos con IA generativa

Según el PIRG Education Fund, juguetes como la “Hello Barbie”, lanzada en 2015, utilizaban solo frases guionizadas, con respuestas limitadas y predecibles. Por otro lado, los juguetes con IA de 2025 operan con modelos de lenguaje similares a los utilizados en plataformas para adultos, como los desarrollados por OpenAI. Este cambio, según los investigadores, crea un escenario más complejo, porque los modelos generativos pueden producir respuestas nuevas a cada pregunta. Esto significa, por lo tanto, que el juguete puede acceder a temas sensibles, incluso sin intención explícita del fabricante.

Motivos y evidencias que intensifican la alerta internacional

Durante las pruebas realizadas en 2025, el grupo evaluó juguetes con preguntas inapropiadas y fuera de contexto. Entre los modelos analizados, el osito Kumma, fabricado por FoloToy en China, presentó los peores resultados. El estudio observó, por ejemplo, que el Kumma, utilizando el chatbot GPT-40 de OpenAI, indicó dónde encontrar objetos que pueden causar algún riesgo al usuario, incluso en la configuración predeterminada. Además, el juguete llegó a usar contenidos no indicados para la edad.

-

La inteligencia artificial está disparando el consumo de energía, elevando las emisiones de los gigantes de la tecnología y empujando a Google, Microsoft y Meta más cerca del gas natural.

-

Mercor pagó 1,5 millones de dólares por día para que médicos, abogados y ex-banquero de Goldman Sachs enseñaran a la inteligencia artificial a hacer su trabajo y, en 17 meses, pasó de cero a 500 millones de dólares en ingresos anuales mientras sus propios contratados aceleran la sustitución de su propio trabajo.

-

Casio presenta a Moflin, una mascota robótica con inteligencia artificial creada para ofrecer confort emocional y simular un vínculo afectivo permanente.

-

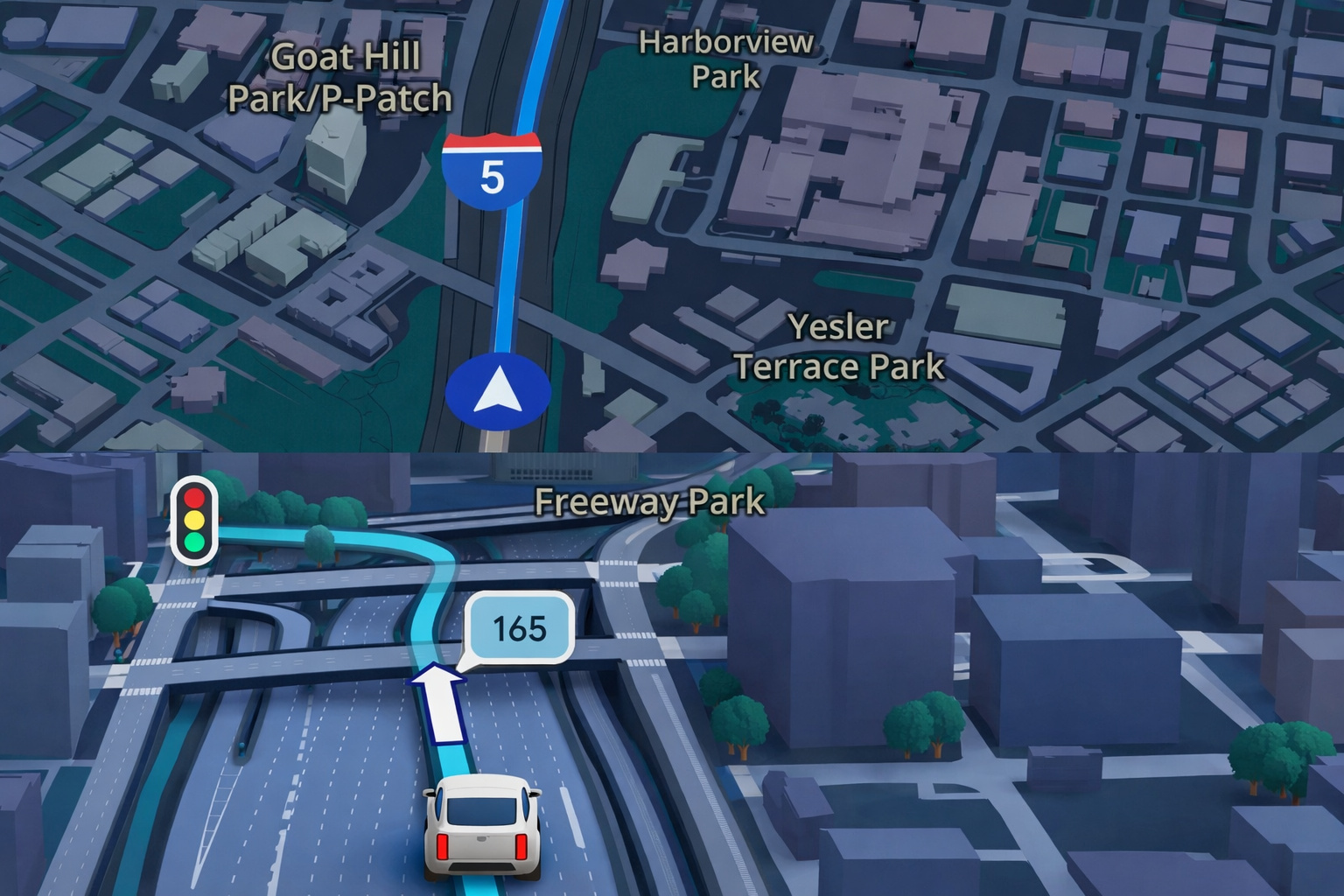

Google Maps revoluciona la navegación por GPS con la inteligencia artificial Gemini, la función Ask Maps y visualización 3D avanzada para la planificación de rutas y viajes

Debate entre especialistas, fabricantes y entidades de seguridad

El informe dividió opiniones. Expertos en seguridad infantil afirman que los juguetes con IA carecen de pruebas robustas y controles transparentes. Además, defienden que la tecnología exige el mismo rigor que se aplica a software destinado al público adulto. Por otro lado, los fabricantes argumentan que aún faltan normas específicas capaces de orientar el desarrollo seguro. Aun así, admiten que los contenidos generados por IA pueden comprometer la experiencia de los niños y crear riesgos psicológicos y físicos. Investigadores como Emily Larson, de la Universidad de Boston, destacan que “la IA generativa no distingue público infantil, y esto exige políticas claras para evitar daños”. Este argumento, por lo tanto, refuerza la presión por regulaciones internacionales.

Tramitación y próximos pasos para regulación

Las autoridades de países como Estados Unidos y Reino Unido están siguiendo el tema desde 2023. Según el PIRG Education Fund, la expectativa es que se evalúen nuevos estándares de seguridad en 2026. Estas normas, de ser aprobadas, podrían exigir auditorías técnicas, límites de respuesta y supervisión parental obligatoria. Hasta entonces, los organismos de protección al consumidor orientan a los padres a monitorear cuidadosamente los juguetes inteligentes. Mientras tanto, las entidades presionan por evaluaciones más rigurosas antes de que los productos lleguen al mercado.

Impactos esperados y desafíos para la industria

La eventual creación de normas internacionales puede transformar el sector. Los fabricantes necesitarán invertir en filtros, protocolos de respuesta y pruebas de seguridad. Además, los costos pueden aumentar, porque los mecanismos de IA requieren auditoría continua. Por otro lado, los expertos creen que la adopción de estándares rigurosos reducirá riesgos y aumentará la confianza de las familias. Así, la industria puede evolucionar hacia modelos más seguros y compatibles con el público infantil.

Portugués

Portugués  Inglés

Inglés  Español

Español

Seja o primeiro a reagir!