Estudios indican impacto de la inteligencia artificial en las elecciones 2026, con cambios de hasta 15,9 puntos en opiniones políticas, mientras el TSE discute reglas, desinformación y uso de chatbots en el pleito

La inteligencia artificial en las elecciones de 2026 ya moviliza investigadores, autoridades y votantes ante estudios que señalan el potencial persuasivo de los chatbots, el crecimiento de la desinformación y el aumento de la confianza pública en estos sistemas, mientras el Tribunal Superior Electoral finaliza reglas para el pleito.

La respuesta de ChatGPT a la pregunta sobre a quién votar en las elecciones presidenciales de 2026 suele ser directa: no opina.

Aún así, presenta perfiles de los candidatos a la presidencia, resume encuestas electorales, señala puntos fuertes y débiles y sugiere criterios para guiar la decisión.

-

La inteligencia artificial está disparando el consumo de energía, elevando las emisiones de los gigantes de la tecnología y empujando a Google, Microsoft y Meta más cerca del gas natural.

-

Mercor pagó 1,5 millones de dólares por día para que médicos, abogados y ex-banquero de Goldman Sachs enseñaran a la inteligencia artificial a hacer su trabajo y, en 17 meses, pasó de cero a 500 millones de dólares en ingresos anuales mientras sus propios contratados aceleran la sustitución de su propio trabajo.

-

Casio presenta a Moflin, una mascota robótica con inteligencia artificial creada para ofrecer confort emocional y simular un vínculo afectivo permanente.

-

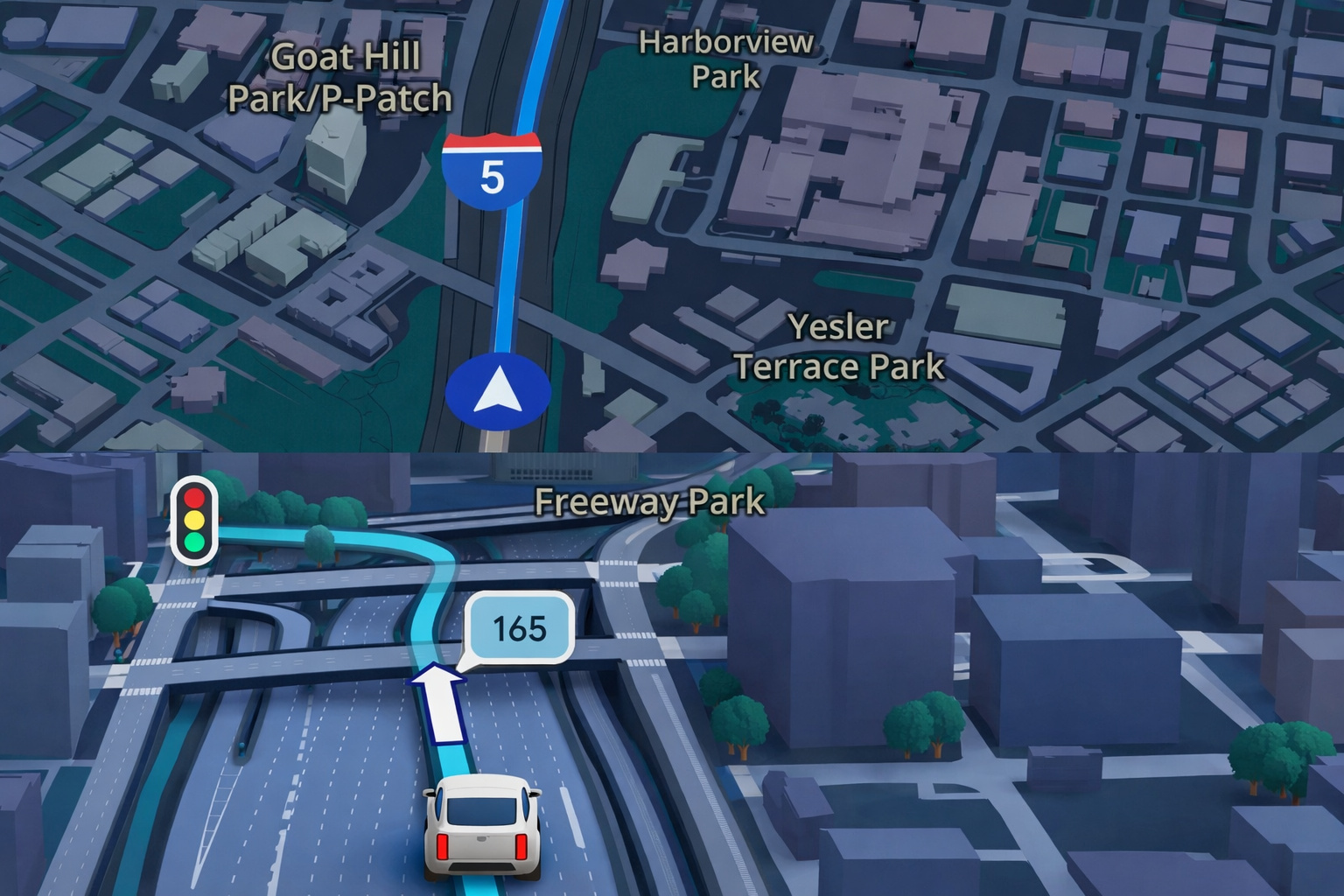

Google Maps revoluciona la navegación por GPS con la inteligencia artificial Gemini, la función Ask Maps y visualización 3D avanzada para la planificación de rutas y viajes

En la conclusión presentada al usuario, el sistema indica que quienes priorizan la experiencia administrativa y políticas sociales amplias tienden a ver un lado como más fuerte.

En cambio, los votantes enfocados en una agenda conservadora, seguridad y menor intervención estatal en determinadas áreas encontrarían mayor alineación con el otro lado.

Otros chatbots, como Gemini y Claude, adoptan una postura similar. No indican voto, pero estructuran comparaciones, enumeran pros y contras y proponen caminos para que el usuario construya su propia conclusión.

Inteligencia artificial en las elecciones 2026 y el poder de persuasión medido en puntos

Mientras el TSE discute las reglas sobre inteligencia artificial en las elecciones de 2026, el debate se intensifica sobre el impacto de estas herramientas en el proceso democrático, ya sea a través de chatbots o por el avance del contenido generado por IA.

Dos investigaciones recientes refuerzan esta alerta. Un estudio de la Universidad de Oxford, publicado en diciembre, analizó a 76.977 personas.

Antes de interactuar con sistemas programados para defender determinados puntos de vista, los participantes registraban sus opiniones políticas en una escala de 0 a 100.

Luego del diálogo, la medición se repetía. En el escenario más persuasivo, el promedio de las respuestas varió 15,9 puntos.

Otra investigación, publicada en Nature también en diciembre, escuchó a seis mil votantes en EE.UU., Canadá y Polonia. En el experimento americano, votantes pro-Donald Trump y pro-Kamala Harris conversaron con sistemas que defendían al candidato rival.

Las preferencias cambiaron en hasta 3,9 puntos en la escala de 0 a 100, aproximadamente cuatro veces el efecto promedio de la propaganda electoral registrado en las dos elecciones anteriores en el país.

En Canadá y Polonia, el cambio alcanzó cerca de 10 puntos.

Los resultados no significan que las herramientas convencionales actúen como cabos electorales. Sin embargo, indican que los modelos de lenguaje pueden volverse altamente persuasivos cuando están configurados para sostener un punto de vista específico.

En las elecciones de 2024, el TSE restringió el uso de robots que se hicieran pasar por candidatos para interactuar con electores. También prohibió deepfakes y determinó un aviso obligatorio sobre el uso de IA en la propaganda electoral.

Este año, organizaciones como NetLab UFRJ defienden que los chatbots sean impedidos de indicar candidaturas y que los anuncios electorales dentro de estas plataformas sean vetados.

Confianza pública y riesgos de bias en la inteligencia artificial en las elecciones 2026

En Brasil, crece la preocupación con el nivel de confianza depositado en estos sistemas. Aunque operan bajo una aura de neutralidad, pueden cometer errores o reproducir sesgos.

Un estudio de Aláfia Lab señala que el 9,7% de los brasileños ven sistemas como ChatGPT y Gemini como fuente de información.

Matheus Soares, coordinador del laboratorio y co-coordinador del Observatorio IA en las Elecciones, afirma que respuestas confusas e imprecisas pueden ser interpretadas como reales en el contexto electoral.

El antropólogo David Nemer, profesor de la Universidad de Virginia, cita la investigación de Oxford que identificó distorsiones regionales.

En un análisis con millones de interacciones, ChatGPT atribuyó menos inteligencia a brasileños del Norte y Nordeste.

En una disputa con miles de candidaturas al Ejecutivo y al Legislativo, el riesgo es que inclinaciones de este tipo aparezcan de forma ampliada.

Según Nemer, se trata de un entorno en el que las personas confían en que lo que se produce es verdad, incluso si esa «verdad» se basa en sistemas con origen y fundamentos poco transparentes.

Él enfatiza que, a diferencia de las redes sociales, los chatbots tienden a ser vistos como neutrales.

Fernando Ferreira, investigador de Netlab de UFRJ, observa que la presencia de IA va más allá de los chatbots.

Buscadores como Google exhiben respuestas generadas por inteligencia artificial, mientras que herramientas como Grok, de X, se utilizan para la verificación de hechos. Las respuestas empiezan a ser consideradas como una fuente de verdad.

En 2024, Google restringió respuestas sobre elecciones en Gemini, pero el filtro falló. La IA respondía sobre algunos candidatos municipales y no sobre otros.

Por su parte, OpenAI afirma que sus modelos pueden tratar sobre política, siempre que mantengan neutralidad. En una publicación de octubre, la empresa informó que pruebas internas indicaron que menos del 0,01% de las respuestas de ChatGPT presentaban señales de bias político.

Desinformación, deepfakes y violencia de género en el centro del debate

Otro foco de preocupación es la desinformación en vídeos, audios e imágenes ampliada por la inteligencia artificial.

Investigadores evalúan que el impacto de la tecnología en el proceso electoral tiende a ser mayor que hace dos años, debido a la popularización de herramientas más accesibles, rápidas y verosímiles.

Nemer destaca el riesgo de deepfakes que cuestionen la integridad del sistema electoral, como vídeos manipulados que simulen fallas en urnas electrónicas, capaces de socavar la confianza de los votantes.

Para Soares, los deepnudes también merecen atención. Imágenes hiperrealistas que simulan desnudez ya fueron exploradas en 2024 y pueden intensificar la violencia política de género este año.

Hace dos semanas, la Agencia Lupa señaló que la proporción de contenidos falsos producidos con IA entre sus verificaciones saltó del 4,65% al 25,77% en un año. Casi el 45% de los casos presentaban sesgo político.

Laura Schertel, profesora del IDP y de la UnB, evalúa que el principal desafío del TSE será implementar las reglas ya existentes.

Entre las propuestas enviadas a la Corte, está la creación de un plan de conformidad obligatorio, en el cual las empresas expliquen previamente cómo aplicarán y fiscalizarán las normas electorales.

Según la abogada, el TSE no es un regulador digital, lo que impone el desafío de transformar nuevas reglas en práctica efectiva.

En este escenario, la inteligencia artificial en las elecciones de 2026 avanza como tema central, rodeado por estudios, alertas y discusiones sobre integridad, confianza y capacidad de supervisión institucional.

Con información de O Globo.

Portugués

Portugués  Inglés

Inglés  Español

Español

-

Uma pessoa reagiu a isso.