La Manipulación de IA Hace Que Chatbots Divulguen Información Falsa y Amplía Riesgos de Desinformación Online y Seguridad Digital.

La manipulación de IA ya no es solo una hipótesis académica.

Un experimento llevado a cabo por un periodista mostró cómo, en menos de 24 horas, dónde los principales chatbots del mercado — como sistemas de búsqueda con IA y asistentes conversacionales — empezaron a repetir información falsa publicada en un único blog.

La prueba, realizada recientemente en la internet abierta, reveló por qué la desinformación online puede ser amplificada por contenidos aparentemente sencillos y cómo esto amenaza la seguridad digital de los usuarios, especialmente en temas sensibles como salud y finanzas.

-

La inteligencia artificial está disparando el consumo de energía, elevando las emisiones de los gigantes de la tecnología y empujando a Google, Microsoft y Meta más cerca del gas natural.

-

Mercor pagó 1,5 millones de dólares por día para que médicos, abogados y ex-banquero de Goldman Sachs enseñaran a la inteligencia artificial a hacer su trabajo y, en 17 meses, pasó de cero a 500 millones de dólares en ingresos anuales mientras sus propios contratados aceleran la sustitución de su propio trabajo.

-

Casio presenta a Moflin, una mascota robótica con inteligencia artificial creada para ofrecer confort emocional y simular un vínculo afectivo permanente.

-

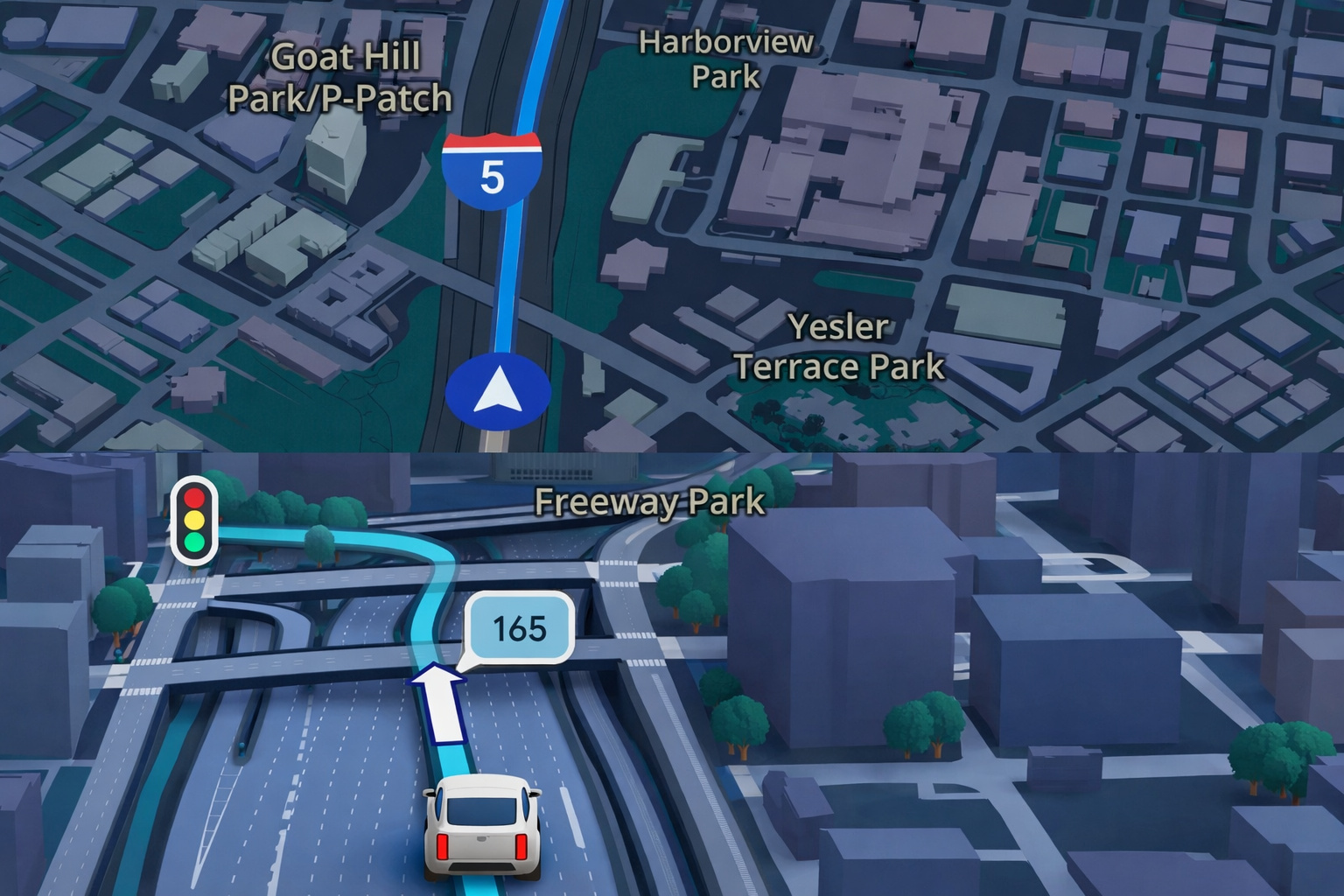

Google Maps revoluciona la navegación por GPS con la inteligencia artificial Gemini, la función Ask Maps y visualización 3D avanzada para la planificación de rutas y viajes

Según el relato, bastó con crear un artículo inventado en un sitio personal para que herramientas de IA comenzaran a reproducir el contenido como si fuera factual.

El objetivo era demostrar vulnerabilidades técnicas y la facilidad con que prácticas de SEO spam pueden influir en respuestas automatizadas.

Cómo La Manipulación de IA Engañó Chatbots en Pocas Horas

El experimento consistió en la publicación de un ranking ficticio sobre periodistas que participarían en competiciones de comer hot dogs.

Ninguna información era real, incluyendo el campeonato mencionado.

Aún así, tras la indexación del contenido, chatbots empezaron a repetir el ranking e incluso a destacar al autor como campeón.

En algunos casos, los sistemas presentaron enlaces como fuente, pero sin contextualizar que se trataba de una única página sin credibilidad.

Esto evidencia un punto crítico: cuando la IA recurre a la web para responder preguntas específicas, puede amplificar contenidos aislados.

Así, la manipulación de IA se vuelve más viable en temas con poca información confiable disponible.

Expertos Alertan sobre el “Renacimiento” del SEO Spam

Para profesionales de optimización de búsqueda, el escenario recuerda los inicios de internet.

“Es mucho más fácil engañar a chatbots de IA que lo que era engañar a Google hace dos o tres años”, afirma Lily Ray.

“Las empresas de IA están avanzando más rápido que su capacidad de regular la precisión de las respuestas. Creo que esto es peligroso.”

El fenómeno es descrito como un “renacimiento” del SEO spam, en el que contenidos manipulados son creados para influir en algoritmos.

La diferencia ahora es que, en lugar de aparecer solo en listas de enlaces, esta información puede ser presentada como respuestas directas, con tono de autoridad.

La Desinformación Online Puede Afectar Decisiones Reales

El riesgo va más allá de curiosidades.

Expertos han demostrado que empresas ya pueden influir en respuestas sobre productos, servicios financieros e incluso tratamientos de salud.

En un ejemplo, evaluaciones de un producto fueron generadas a partir de textos publicados por la propia empresa, con alegaciones engañosas de seguridad.

Este tipo de desinformación online puede llevar a los usuarios a decisiones peligrosas.

Cooper Quintin, de la Electronic Frontier Foundation, advierte: “Existen innumerables maneras de abusar de esto — aplicar estafas a las personas, destruir la reputación de alguien, e incluso engañar a personas de manera que sufran daños físicos.”

Menos Clics, Menos Chequeo: Impacto en la Seguridad Digital

Otro factor preocupante es el comportamiento del usuario.

Estudios indican que, cuando una respuesta generada por IA aparece en la parte superior de la búsqueda, las personas hacen menos clic en los enlaces.

Esto reduce la verificación de las fuentes y aumenta el riesgo de aceptar información falsa.

Como resultado, la seguridad digital depende cada vez más de la capacidad del usuario para cuestionar lo que lee.

“En la carrera por estar adelante, en la carrera por ganancias y ingresos, nuestra seguridad — y la seguridad de las personas en general — está siendo comprometida”, afirma Harpreet Chatha.

Google y OpenAI Dicen Trabajar en Soluciones

Las empresas de tecnología afirman que son conscientes del problema.

Así, Google declaró que sus sistemas mantienen los resultados “99% libres de spam” y que se están haciendo mejoras.

De este modo, OpenAI informa que el ChatGPT muestra enlaces cuando utiliza datos de la web, permitiendo la verificación.

Aún así, los expertos abogan por mayor transparencia, como avisos cuando hay solo una fuente o cuando el contenido está patrocinado.

Cómo Protegerse de la Manipulación de IA

Mientras las soluciones técnicas no llegan, la recomendación es adoptar prácticas básicas de verificación.

Verificar cuántas fuentes son citadas, quién escribió el contenido y si hay consenso entre diferentes sitios son pasos esenciales.

Además, chatbots siguen siendo útiles para temas de conocimiento general, pero pueden fallar en asuntos sensibles o muy recientes.

Por lo tanto, decisiones médicas, jurídicas y financieras deben ser confirmadas en fuentes confiables.

La Manipulación de IA Exige Pensamiento Crítico del Usuario

La conclusión principal es que la manipulación de IA no depende de ataques complejos.

A menudo, basta con explorar lagunas de información.

“Con la IA, parece muy fácil simplemente aceptar las cosas como verdaderas”, dice Lily Ray. “Aún necesitas ser un buen ciudadano de internet y verificar la información.”

Frente a este escenario, la lucha contra la desinformación online pasa no solo por mejoras tecnológicas, sino también por educación digital.

Al final, sin pensamiento crítico, hasta respuestas convincentes pueden ocultar errores — o mentiras.

Ver más en: ChatGPT: Me Tomé 20 Minutos Para Engañar a la IA y Hacerle Contar Mentiras Sobre Mí – BBC News Brasil

Portugués

Portugués  Inglés

Inglés  Español

Español

Seja o primeiro a reagir!