El robot EMO aprende solo a sincronizar labios con el habla usando IA, espejo y videos, avance puede cambiar la interacción humano-robot

En enero de 2026, investigadores de la Universidad de Columbia publicaron en la revista Science Robotics un estudio que redefine los límites de la interacción entre humanos y máquinas. El robot humanoide EMO logró aprender solo a sincronizar movimientos labiales con el habla y el canto, utilizando inteligencia artificial, observación de su propio reflejo en un espejo y análisis de videos humanos.

El avance representa un salto técnico relevante en la robótica humanoide, especialmente en uno de los desafíos más complejos del área: la naturalidad facial. Por primera vez, un robot demuestra articulación labial en múltiples idiomas con un nivel de realismo suficiente para reducir el efecto conocido como “valle de la extrañeza”.

El valle de la extrañeza en la robótica humanoide explica por qué los rostros artificiales causan incomodidad

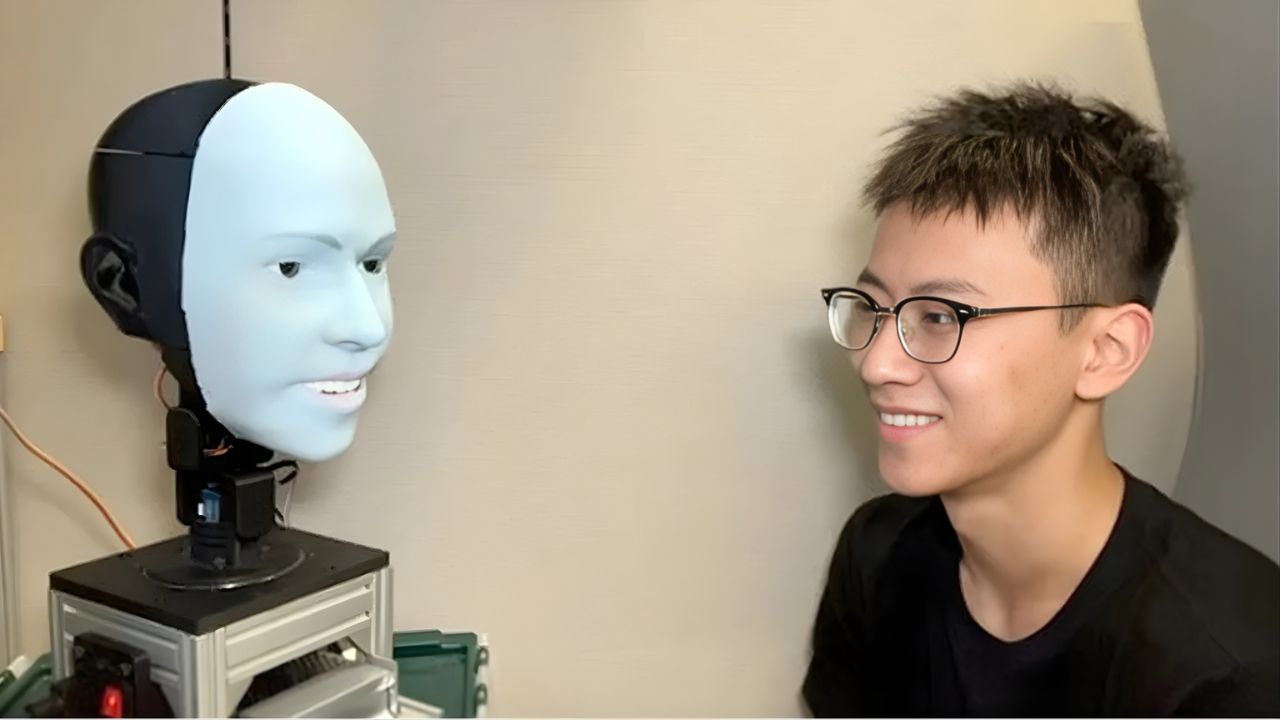

Casi la mitad de la atención de una persona durante una conversación presencial se concentra en el movimiento de los labios del interlocutor. Aun así, los robots humanoides más avanzados del mundo todavía presentan movimientos faciales limitados o artificiales.

-

Oficina de fundición de hierro en Senegal revela pila con 100 toneladas de escoria, 35 bases de hornos y técnica rara que se mantuvo estable durante siglos.

-

La única construcción del mundo hecha por el ser humano que puede ser vista claramente desde el espacio no son las pirámides de Egipto ni la Gran Muralla de China.

-

Un análisis de la NASA destacó que la Gran Muralla China y las Pirámides de Egipto no son visibles a simple vista desde la Estación Espacial Internacional, y solo una estructura hecha por el hombre es visible de esta manera.

-

Un sumergible chino encuentra en el fondo del Pacífico un sistema colosal de cráteres gigantes hasta ahora desconocidos, repletos de vida y tan ricos en hidrógeno que pueden ayudar a explicar el origen de la vida en la Tierra.

El problema radica en el llamado “valle de la extrañeza”, concepto introducido por el roboticista Masahiro Mori en 1970. Este fenómeno describe la reacción negativa que ocurre cuando un robot se acerca a la apariencia humana, pero no alcanza un nivel convincente de realismo.

Mientras que los movimientos corporales imprecisos son tolerados, pequeñas inconsistencias en la sincronización labial generan incomodidad inmediata. Esto llevó a muchas empresas a evitar rostros expresivos en robots, priorizando estructuras rígidas para reducir el rechazo.

El robot EMO usa 26 motores bajo piel de silicona para simular músculos faciales humanos

El equipo liderado por Hod Lipson desarrolló un sistema innovador compuesto por 26 motores miniaturizados posicionados bajo una piel flexible de silicona. Cada motor opera con múltiples grados de libertad, permitiendo combinaciones complejas de movimiento.

Este diseño simula la actuación de músculos faciales humanos, que controlan expresiones y articulación labial. A diferencia de los sistemas tradicionales, el EMO no utiliza movimientos preprogramados para cada fonema.

La estructura mecánica avanzada es esencial para permitir que el aprendizaje por inteligencia artificial se traduzca en movimientos físicos realistas.

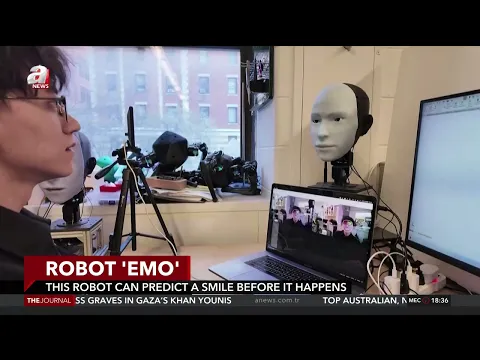

La inteligencia artificial aprende sincronización labial observando su propio reflejo en el espejo

El proceso de aprendizaje del EMO se dividió en dos etapas. En la primera fase, el robot fue colocado frente a un espejo y comenzó una serie de movimientos faciales aleatorios.

Al observar su propio reflejo, el sistema de visión computacional registró cómo cada combinación de motores alteraba la forma de la boca y del rostro. Este proceso permitió al robot construir un modelo interno que relaciona movimientos físicos con resultados visuales.

Este método, conocido como “vision-to-action” (VLA), permite que el robot aprenda sin reglas predefinidas. El EMO descubrió solo cómo controlar sus movimientos faciales, replicando un proceso similar al aprendizaje humano.

El robot aprende a hablar y cantar analizando videos humanos en YouTube

En la segunda fase, el EMO fue expuesto a videos de humanos hablando y cantando. La inteligencia artificial analizó cómo los labios se mueven en diferentes sonidos y patrones de habla.

El sistema no copia directamente los movimientos, sino que generaliza la relación entre sonido y forma. Con base en el modelo construido en la fase anterior, el robot adapta estos patrones a su propio rostro.

Este método permite que el EMO articule palabras en idiomas que no fueron previamente programados. La universalidad de la formación de los fonemas permite que el sistema funcione en múltiples lenguas.

El robot EMO habla múltiples idiomas y canta música generada por inteligencia artificial

En las pruebas presentadas, el EMO demostró capacidad de sincronizar labios con el habla en diferentes idiomas, incluyendo inglés y mandarín. Además, el robot fue capaz de cantar canciones con sincronización labial precisa.

El proyecto incluye un álbum musical generado por inteligencia artificial, llamado “hello world_”, utilizado como demostración técnica. El canto representa un desafío mayor que el habla, debido a la necesidad de sincronización con ritmo, tono y duración de las notas.

El éxito en esta tarea indica que el sistema alcanzó un nivel elevado de coordinación entre audio y movimiento facial.

Las pruebas muestran que los humanos prefieren el modelo de IA del EMO en el 62,5% de los casos

Investigadores compararon el desempeño del EMO con otros dos métodos tradicionales de sincronización labial. En pruebas con voluntarios, el modelo basado en aprendizaje por observación fue preferido en el 62,5% de los casos.

Los métodos competidores, basados en intensidad sonora y copia directa de movimientos, tuvieron un desempeño significativamente inferior.

A pesar de esto, el sistema aún presenta limitaciones, especialmente en sonidos que requieren el cierre completo de los labios, como “B” y “P”.

Aún con restricciones, los resultados indican un avance significativo en la naturalidad de la comunicación humano-robot.

La importancia de la expresión facial en robots crece con el avance de la interacción humano-máquina

Estudios de seguimiento ocular indican que los humanos pasan alrededor del 87% del tiempo mirando la cara durante una conversación, siendo hasta un 15% enfocado en la boca.

Esto refuerza la importancia de la expresión facial para robots que actúan en entornos como atención, salud, educación y asistencia a ancianos.

Según los investigadores, la capacidad de mover correctamente ojos y labios será esencial para la aceptación social de robots humanoides.

La expresión facial deja de ser un detalle estético y pasa a ser un requisito funcional para una interacción eficiente.

El mercado global puede producir más de 1 billón de robots humanoides en la próxima década

Proyecciones económicas indican que más de 1 billón de robots humanoides pueden ser producidos en los próximos años. Estos sistemas deberán actuar en diferentes sectores, incluyendo industria, servicios y cuidado personal.

En este escenario, la necesidad de interacción natural con humanos se vuelve crítica. Robots con rostros poco convincentes tienden a generar rechazo, limitando su adopción. La tecnología desarrollada por Columbia puede convertirse en estándar para futuras generaciones de robots.

Además del EMO, otras empresas ya trabajan en soluciones para la expresión facial en robots. La empresa china AheadForm presentó en 2025 un modelo de cabeza robótica con movimientos altamente realistas.

Estas iniciativas indican que la industria avanza hacia la integración de hardware avanzado con aprendizaje por inteligencia artificial. La convergencia entre mecánica e IA puede acelerar la llegada de robots con apariencia y comportamiento cada vez más cercanos a los humanos.

El aprendizaje por observación sustituye la programación tradicional en la robótica

El diferencial central del humanoide EMO está en la forma en que aprende. En lugar de seguir reglas programadas, el robot desarrolla sus habilidades por observación y experimentación.

Este método se asemeja al aprendizaje humano, en el cual los niños observan, prueban y ajustan comportamientos a lo largo del tiempo. Este cambio de paradigma puede redefinir el desarrollo de sistemas robóticos inteligentes.

Los propios investigadores reconocen que la evolución de robots emocionalmente convincentes trae riesgos. A medida que las máquinas se vuelven más realistas, aumenta la posibilidad de creación de vínculos emocionales artificiales.

Esto puede impactar áreas como el cuidado de ancianos, donde la interacción con robots puede sustituir relaciones humanas. La evolución tecnológica exige un debate sobre los límites éticos y sociales de la interacción humano-máquina.

El humanoide EMO representa un avance significativo en la robótica humanoide al demostrar que las máquinas pueden aprender a expresarse de forma más natural. La combinación de inteligencia artificial, aprendizaje por observación y ingeniería mecánica avanzada apunta a un futuro en el que la comunicación entre humanos y robots será cada vez más fluida.

Lo que antes se veía como una limitación estructural de la robótica ahora comienza a ser superado con soluciones que acercan a las máquinas al comportamiento humano.

Portugués

Portugués  Inglés

Inglés  Español

Español

Seja o primeiro a reagir!