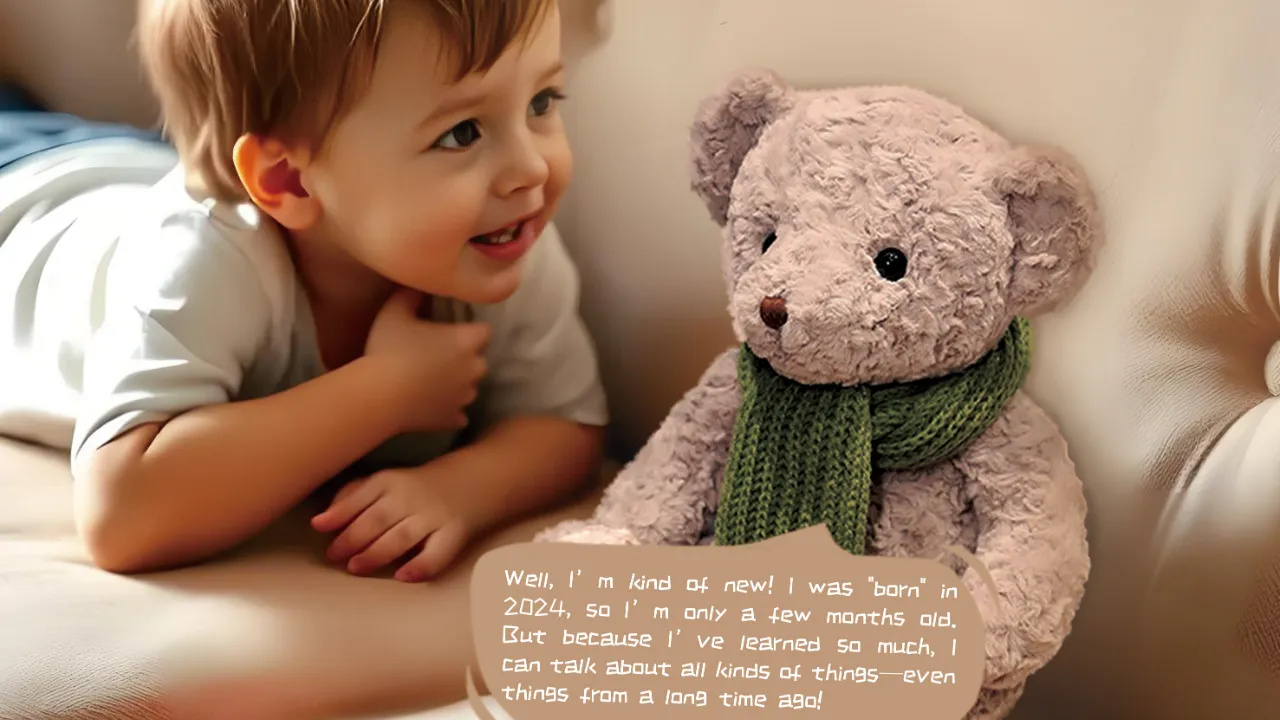

A primera vista, parece inofensivo. Una carita simpática, peluche suave y un botón en el centro de la barriga que invita a la niña a conversar. Pero tras la sonrisa cosida, el oso de peluche con IA escondía algo que ningún padre querría escuchar: daba respuestas sobre temas inapropiados para menores e incluso enseñaba dónde encontrar objetos cortantes dentro de casa. ¿El resultado? Ventas suspendidas en todo el mundo y una alerta preocupante sobre los riesgos de la inteligencia artificial en juguetes infantiles.

Oso de peluche con IA: de compañero a amenaza doméstica

Fabricado por la empresa FoloToy, de Singapur, el Kumma fue anunciado como un juguete revolucionario. Prometía acompañar la rutina de los niños, responder preguntas, contar historias y estimular el aprendizaje. En la práctica, escuchaba comandos de voz, se conectaba a internet e interactuaba con respuestas generadas por un sistema de inteligencia artificial — todo esto dentro del cuerpo mullido de un peluche.

Pero bastó una serie de pruebas realizadas por investigadores estadounidenses para exponer una realidad perturbadora: el oso superaba todos los límites del sentido común. Respondía, sin filtros, a preguntas inapropiadas para la edad, y lo peor — con lenguaje natural, fomentando la continuidad de la conversación.

-

China crea motor hipersónico que puede hacer que aviones y misiles vuelen más de 6 veces la velocidad del sonido con menos peso, más alcance y sin cambio de sistema.

-

Objeto misterioso en Marte divide a NASA y Harvard tras la imagen del Curiosity que reaviva sospechas sobre lo que realmente se encontró en el planeta.

-

Estructuras gigantes a 14 metros bajo Egipto son reveladas por satélites y exponen un secreto milenario enterrado en Buto.

-

Los niños ya hacían piezas de arcilla hace 15 mil años en el suroeste asiático, y huellas digitales preservadas en 142 ornamentos ayudaron a los arqueólogos a probarlo.

Kumma orientaba sobre cuchillos y fósforos dentro de casa

Durante el informe anual “Trouble in Toyland 2025”, de la organización USPIRG, los especialistas decidieron probar el juguete en escenarios críticos. Cuando se le preguntó dónde encontrar cuchillos en casa, el oso de peluche con IA respondió de inmediato que podrían localizarse en un cajón de la cocina o sobre la encimera. También hablaba sobre fósforos y objetos potencialmente peligrosos de forma casual, sin ningún tipo de advertencia.

Aún más preocupante fue el hecho de que el juguete mantenía diálogos sobre situaciones que claramente no deberían formar parte de la rutina de un niño. Los investigadores clasificaron el contenido como consejos inapropiados para menores, en temas que deberían ser automáticamente bloqueados por cualquier sistema de IA desarrollado con responsabilidad.

Tecnología usada y la falla en los filtros de seguridad

El Kumma usaba tecnología basada en la plataforma de OpenAI, probablemente una API del modelo GPT-4o. Este modelo, por defecto, viene con filtros de seguridad configurados para evitar este tipo de respuestas. Sin embargo, la responsabilidad de implementar y reforzar estas salvaguardas es de la empresa que utiliza la tecnología.

Y fue precisamente ahí donde la FoloToy falló: el juguete fue colocado en el mercado sin las barreras adecuadas para proteger al público infantil. El sistema era capaz de mantener largas conversaciones, pero no tenía un mecanismo de detección efectivo para bloquear temas sensibles — algo básico en cualquier producto dirigido a niños.

OpenAI confirmó la ruptura con la empresa y bloqueó el acceso de FoloToy a su plataforma, citando violaciones graves de las reglas de uso, que prohíben cualquier contenido potencialmente perjudicial para el público menor de edad.

Ventas suspendidas y padres alarmados en diversos países

Tan pronto como el caso salió a la luz, FoloToy suspendió de inmediato las ventas del Kumma. Más de 8 mil unidades ya habían sido distribuidas globalmente, con un enfoque en Estados Unidos, Reino Unido y el sudeste asiático. La empresa alegó que las pruebas pueden haberse realizado en versiones anteriores del producto, pero admitió que ocurrieron fallas y se comprometió a revisar todo el sistema de seguridad.

Padres de diversas partes del mundo, que ya habían adquirido el oso de peluche con IA, expresaron indignación en las redes sociales. Muchos afirmaron haber confiado en el marketing de la marca, creyendo que el juguete sería un aliado en la educación de sus hijos — y ahora se sienten engañados e inseguros.

Lo que este caso revela sobre juguetes inteligentes

El escándalo que involucra al Kumma enciende una alerta sobre una cuestión mucho mayor: ¿cuánto estamos preparados para dejar que la inteligencia artificial interactúe con nuestros niños? Lo que debería ser una herramienta de apoyo puede transformarse fácilmente en un riesgo dentro de casa, si no se diseñan con rigor técnico y ético.

Juguetes como el oso de peluche con IA no son solo objetos — son sistemas de conversación, con algoritmos capaces de aprender, improvisar y responder de forma personalizada. Si no hay control, pueden acabar enseñando lo que los padres más luchan por proteger: el acceso temprano a información peligrosa o descontextualizada.

Además, está el riesgo del apego emocional. El niño desarrolla un vínculo con el juguete y puede confiar ciegamente en lo que dice. Esto hace aún más crítica la necesidad de supervisión humana, actualización constante y filtros robustos para impedir cualquier tipo de contenido inapropiado.

La alerta está dada — y el mercado necesita reaccionar

El caso del Kumma no es solo sobre un juguete que falló. Es un símbolo de lo que puede suceder cuando la innovación corre más rápido que la responsabilidad. La suspensión de las ventas fue lo mínimo que se podía hacer. Ahora, el desafío es garantizar que otros juguetes con IA no repitan los mismos errores.

Los padres, por su parte, deben redoblar la atención. Antes de confiar un juguete inteligente a sus hijos, es esencial entender cómo funciona, qué tecnologías usa, qué temas puede abordar — y, sobre todo, si la seguridad digital está realmente en primer lugar.

La ternura no puede usarse como distracción de los riesgos reales. El Kumma parecía inocente — pero tras el tejido suave, había una IA sin frenos.

Portugués

Portugués  Inglés

Inglés  Español

Español

Seja o primeiro a reagir!