Con nombre en clave Lumberjack, el drone de Northrop Grumman cazó objetivos con IA durante un ejercicio real de la división que saltó en Normandía

Durante la Operation Lethal Eagle, uno de los mayores ejercicios de preparación del Ejército de los Estados Unidos, un dron de combate llamado Lumberjack voló de forma autónoma y simuló ataques de precisión contra objetivos terrestres.

Según DefenseScoop, la prueba se realizó en abril de 2026 para la 101ª División Aerotransportada — la misma unidad que saltó sobre Normandía el Día D.

El dron fue integrado al Maven Smart System, construido por Palantir, que utiliza inteligencia artificial para identificar objetivos, analizar datos del campo de batalla y sugerir acciones a los operadores.

-

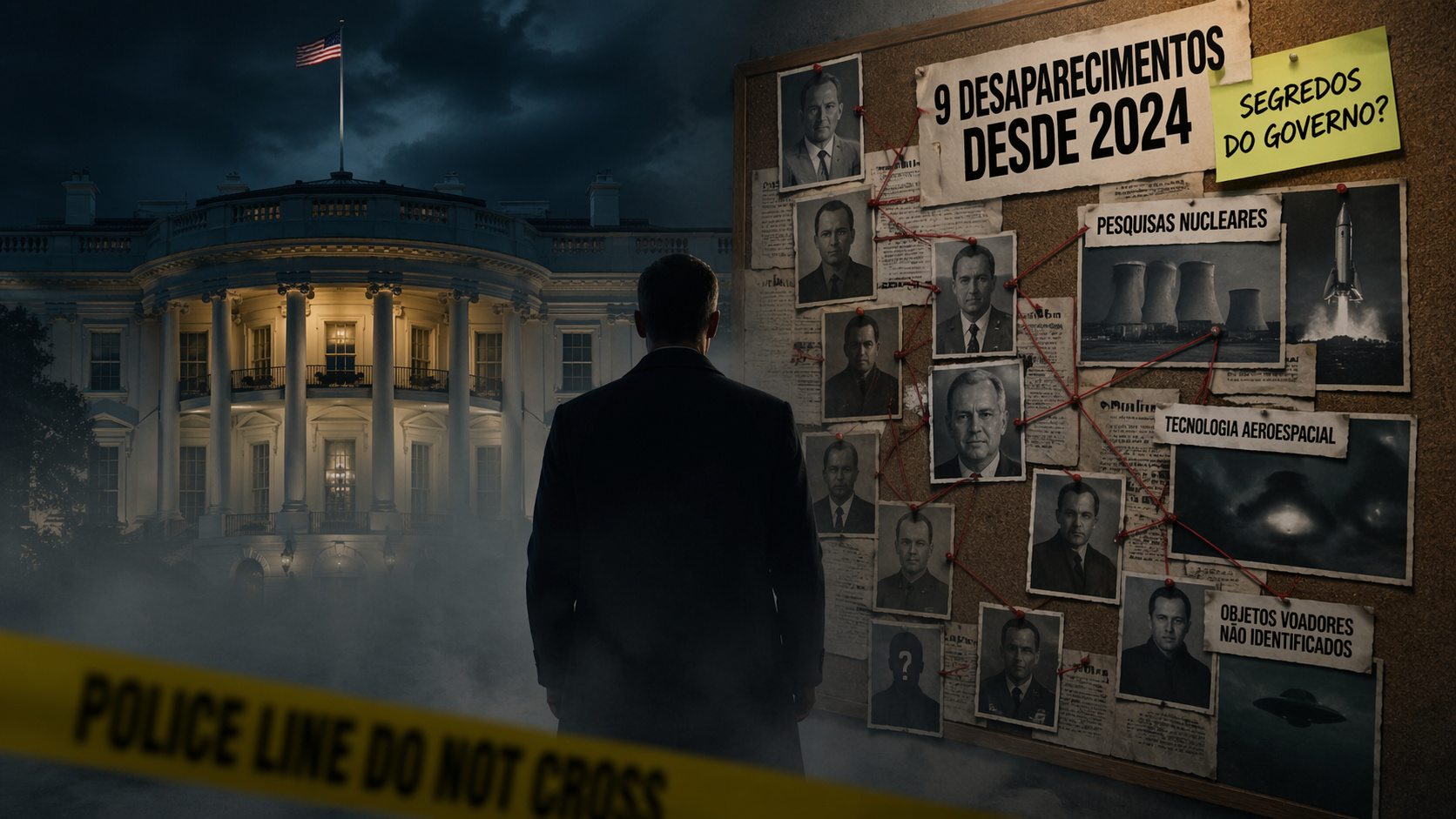

Científicos con acceso a secretos del gobierno están desapareciendo en EE. UU., incluye áreas como energía nuclear y objetos voladores no identificados, ya suma nueve casos desde 2024 y levanta una alerta dentro de la Casa Blanca.

-

Rusia construye cuatro centrales nucleares flotantes en astilleros chinos para alimentar una mina multimillonaria de cobre y oro en el Ártico… y la primera ya ha demostrado que funciona.

-

Este científico reveló haber descubierto la “Matrix”, pero desapareció sin dejar rastro en 1994; conoce al neurocientífico Jacobo Grinberg y la teoría sintérgica

-

China hizo lo que ningún país había logrado al revertir la desertificación a gran escala, y ahora el mundo admite que necesita copiar esas técnicas antes de que miles de millones de hectáreas de suelo se conviertan en polvo.

Además, el sistema cuenta con el Agentic Effects Agent — un agente de IA que automatiza parte del proceso de toma de decisiones en combate.

Despega, identifica, ataca: cómo opera el Lumberjack sin intervención humana directa

El Lumberjack está clasificado como UAS Grupo 3 — una aeronave no tripulada con un peso entre 25 y 600 kg, según los estándares del Departamento de Defensa.

Según detalló Northrop Grumman, es un sistema de ataque de bajo costo y uso único diseñado para el combate moderno.

Por lo tanto, el dron no regresa a la base — es lanzado, ejecuta la misión y se consume en el proceso.

La diferencia radica en el módulo central modular, que permite intercambiar rápidamente entre cargas útiles cinéticas (explosivos) y no cinéticas (interferencia electrónica).

De esta manera, el mismo dron puede tanto destruir un objetivo como silenciar comunicaciones enemigas.

La primera vez que un dron de combate se conectó al Maven Smart System en un ejercicio real

Según Northrop Grumman, la Operation Lethal Eagle fue la primera demostración para clientes en la que el Lumberjack operó integrado al Maven Smart System.

En este sentido, el sistema de Palantir funcionó como el «cerebro» de la operación — recibiendo datos de sensores, procesando imágenes en tiempo real y generando recomendaciones de enfrentamiento.

El dron, por su parte, ejecutaba las órdenes de forma autónoma — desde la planificación de la ruta hasta el momento del ataque simulado.

Sin embargo, los operadores humanos mantuvieron supervisión sobre el proceso. La decisión final de enfrentamiento aún pasa por una estación de comando tripulada.

De la misma manera, el ejercicio sirvió para probar los límites de la autonomía en condiciones cercanas al combate real — sin el riesgo de víctimas.

La 101ª Aerotransportada prueba el futuro de la guerra: drones que reemplazan el primer salto

La elección de la 101ª División Aerotransportada para probar el Lumberjack no es coincidencia.

Igualmente conocida como «Screaming Eagles», la división es la unidad de respuesta rápida más famosa del Ejército estadounidense.

Tradicionalmente, los paracaidistas saltan primero en territorio hostil para abrir camino. Con drones autónomos, el primer «salto» puede ser realizado por máquinas.

Consecuentemente, la integración de drones de ataque autónomo con unidades aerotransportadas crea una nueva doctrina de combate — donde la tecnología reduce el riesgo humano en las fases más peligrosas de la operación.

El debate ético: ¿una máquina debe poder decidir quién vive y quién muere?

Por otro lado, el avance de drones autónomos con capacidad de ataque plantea profundas cuestiones éticas.

Organizaciones internacionales, incluida la Cruz Roja, piden regulación sobre armas letales autónomas — sistemas que pueden seleccionar y atacar objetivos sin intervención humana.

Sobre todo, la velocidad de la toma de decisiones en combate favorece la automatización — pero cada milisegundo menos de reflexión humana es un riesgo adicional de error irreversible.

Aun así, los militares argumentan que mantener a un humano en el circuito sigue siendo un requisito. El Lumberjack sugiere objetivos, pero un operador autoriza el enfrentamiento.

A pesar de ello, la distancia entre «sugerencia automatizada» y «decisión autónoma» se mide en líneas de código — y la presión del combate real puede hacer que esta distinción teórica quede rápidamente obsoleta.

Portugués

Portugués  Inglés

Inglés  Español

Español

¡Sé la primera persona en reaccionar!