La joven galesa Phoebe Tesoriere, de 23 años, recibió diagnósticos erróneos de ansiedad, depresión y epilepsia durante 4 años hasta que, tras salir de un coma de 3 días provocado por una convulsión, digitó sus síntomas en ChatGPT, que sugirió paraplejía espástica hereditaria, confirmada por exámenes genéticos.

Durante cuatro años, una joven de 23 años llamada Phoebe Tesoriere escuchó de médicos que sus problemas eran ansiedad, depresión y epilepsia. La joven, que vive en Cardiff, capital de Gales, llegó a ser advertida por profesionales de salud de que sería tratada como paciente psiquiátrica si continuaba regresando a urgencias. Ninguno de los diagnósticos explicaba el conjunto completo de síntomas que ella presentaba desde la infancia, incluyendo dificultad para caminar, problemas de equilibrio y convulsiones que se volvieron cada vez más graves a lo largo de los años.

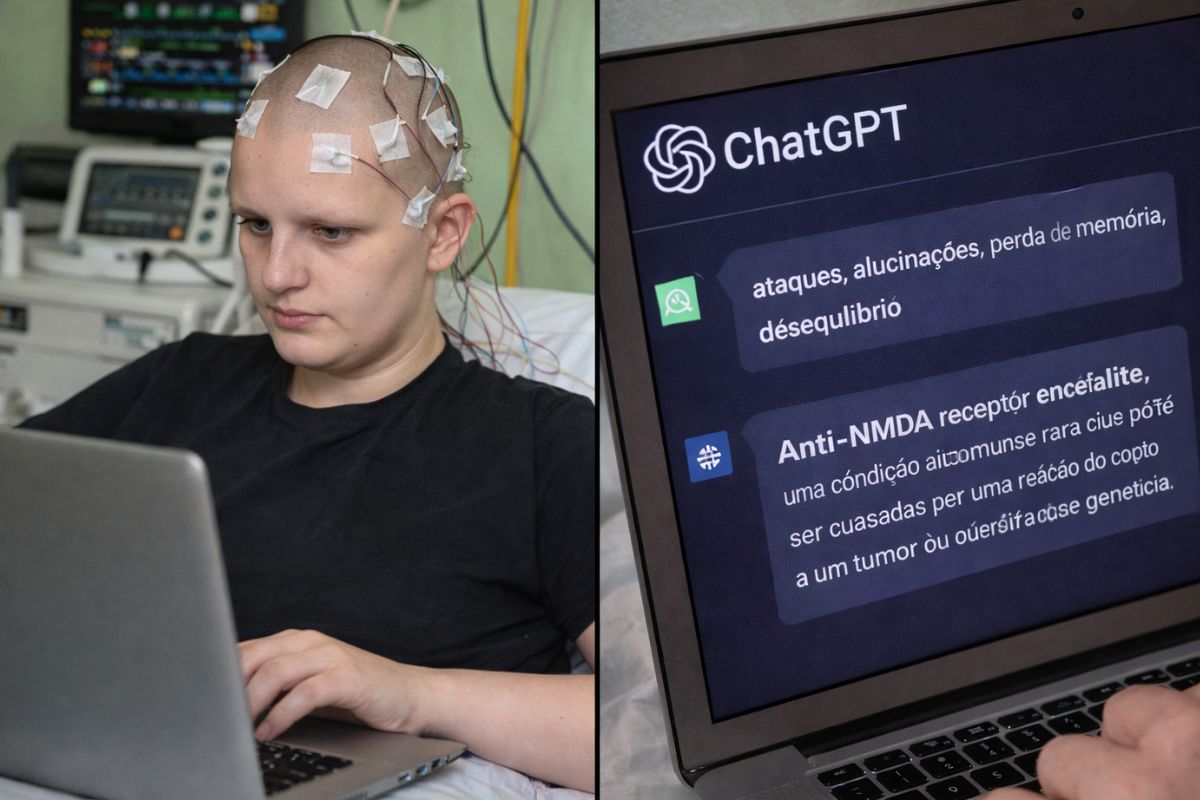

El punto de inflexión ocurrió en julio de 2025, cuando una convulsión grave dejó a la joven en coma durante tres días. Al recuperarse, un médico le dijo a Phoebe que no tenía epilepsia, sino ansiedad, contradiciendo el diagnóstico anterior. Fue entonces cuando la joven decidió digitar sus síntomas en ChatGPT. El chatbot respondió con una lista de posibles condiciones, incluyendo paraplejía espástica hereditaria, una enfermedad rara que afecta la coordinación motora. La joven presentó la sugerencia al médico general, quien estuvo de acuerdo en que era una hipótesis plausible, y exámenes genéticos confirmaron el diagnóstico que ningún médico había considerado en cuatro años de consultas.

Los cuatro años de diagnósticos erróneos que la joven enfrentó antes de ChatGPT

Según g1, la historia de Phoebe Tesoriere comienza en la infancia. La joven cojeó durante toda la infancia, nació sin una cavidad articular en la cadera y pasó por cirugías cuando era bebé. También tenía problemas de equilibrio y llegó a ser evaluada por dispraxia, condición que afecta la coordinación física, pero el resultado fue negativo.

-

China atropella a Elon Musk con un robot humanoide de Unitree a la venta en AliExpress por US$ 6,800, con envío gratis y entrega internacional, transformando tecnología de multimillonarios en algo que cualquier persona puede comprar en línea.

-

A corrida dos robôs humanoides nas fábricas começou pra valer, Hyundai anunciou que vai implantar mais de 25 mil unidades do Atlas em suas linhas de produção a partir de 2028, em uma parceria que envolve a Boston Dynamics e treinamento com o Google DeepMind

-

Rusia quiere construir nuevas plantas nucleares en Brasil y negocia un acuerdo con el gobierno de Lula para ampliar la presencia de Rosatom en proyectos de energía atómica, pequeños reactores y tecnología nuclear pacífica.

-

Fósiles microscópicos de 1,7 mil millones de años encontrados en rocas de Australia revelan células complejas viviendo en el fondo de un mar antiguo y pueden cambiar lo que los científicos saben sobre la evolución de la vida en la Tierra.

Los síntomas siempre fueron atribuidos a las cirugías infantiles, y nadie conectó los puntos entre los diferentes problemas que la joven presentaba.

A los 19 años, la joven se desmayó y tuvo una convulsión en el trabajo, pero los médicos dijeron que era ansiedad. «No tenía historial de ansiedad, era una persona muy feliz y vibrante», relató Phoebe.

En 2022, la joven recibió diagnóstico de epilepsia y comenzó a tomar medicación. En diciembre de 2024, volvió a sentirse mal y no podía mantener la medicación, lo que causó más convulsiones. Fue diagnosticada erróneamente con parálisis de Todd, una condición asociada a la epilepsia. En enero de 2025, cayó de una escalera y pasó tres meses en el hospital con exámenes inconclusos.

El momento en que la joven decidió preguntar a ChatGPT

Tras salir del coma de tres días en julio de 2025, la joven recibió una vez más el diagnóstico de ansiedad en lugar de una explicación neurológica concreta.

Frustrada y sin respuestas después de cuatro años, Phoebe digitó todos sus síntomas en ChatGPT y recibió una lista de condiciones posibles, entre ellas la paraplejía espástica hereditaria. La joven analizó la sugerencia varias veces con su pareja antes de decidir llevar la hipótesis al médico.

«Analicé la cuestión varias veces preguntando ‘¿voy al médico?’, ‘¿no voy?’, ‘¿qué debo hacer?’, ‘seguro que no puede ser esto'», recordó la joven.

El médico de cabecera estuvo de acuerdo en que la paraplejía espástica hereditaria era una razón plausible para el conjunto de síntomas, y pruebas genéticas confirmaron el diagnóstico. Una herramienta de inteligencia artificial encontró en segundos lo que profesionales de salud no identificaron en cuatro años de consultas, hospitalizaciones y exámenes.

Qué es la paraplejía espástica hereditaria que ChatGPT sugirió para la joven

La paraplejía espástica hereditaria es una condición neurológica rara que afecta la capacidad motora y la coordinación. Según el NHS, el servicio de salud pública del Reino Unido, no se sabe cuántas personas sufren de esta condición porque a menudo no se diagnostica.

Los síntomas incluyen rigidez y debilidad progresiva en las piernas, dificultad de equilibrio y problemas de coordinación que pueden confundirse con otras condiciones neurológicas o incluso con trastornos psiquiátricos.

Los síntomas pueden ser controlados con fisioterapia, pero no existe cura para la condición. La joven ya no puede trabajar como profesora de alumnos con necesidades educativas especiales debido a los síntomas y hoy usa silla de ruedas.

A pesar de las limitaciones, Phoebe busca un nuevo camino profesional cursando un máster en psicología, afirmando que aún quiere «hacer algo que ayude a las personas». El diagnóstico correcto, aunque tardío, al menos le permitió entender lo que sucede con su cuerpo y dejar de tomar medicación para epilepsia que nunca tuvo.

Lo que médicos y especialistas dicen sobre usar inteligencia artificial para diagnóstico

La clínica general Rebeccah Tomlinson, que atiende la región de Cardiff, reconoce que la situación refleja una presión real sobre los profesionales de la salud. «Es difícil para los clínicos generales conocerlo todo, y con las presiones sobre el NHS, necesitamos saber aún más», declaró la médica.

Ella recomienda que los pacientes que investiguen síntomas en herramientas de IA lleven los resultados para discutir con profesionales, y que los médicos estén abiertos a escuchar lo que los pacientes traen.

Un estudio reciente de la Universidad de Oxford concluyó que los chatbots de IA proporcionan asesoramiento médico inconsistente, mezclando respuestas buenas y malas, lo que dificulta la identificación de cuáles sugerencias son confiables.

La joven Phoebe tuvo suerte de que la sugerencia del ChatGPT era precisa, pero el mismo sistema podría haber sugerido condiciones incorrectas que llevarían a otros caminos equivocados. Para Tomlinson, las herramientas de IA «son un buen punto de partida, que debe ser seguido por una consulta a un profesional médico para discutir las preocupaciones con más detalles».

Lo que el caso de la joven galesa revela sobre los límites del sistema de salud

La historia de Phoebe expone una falla que va más allá de la competencia individual de los profesionales. Cuando una joven pasa cuatro años escuchando que sus síntomas son ansiedad y es amenazada de ser tratada como paciente psiquiátrica por insistir en que algo está mal, el problema es sistémico.

La tendencia a atribuir síntomas inexplicados a trastornos psiquiátricos, especialmente en mujeres jóvenes, está documentada en la literatura médica y fue exactamente lo que le ocurrió a Phoebe antes de que el ChatGPT ofreciera una alternativa.

El Consejo de Salud de la Universidad de Cardiff y Vale declaró que «lamenta saber de la experiencia de Phoebe» pero no comentó sobre el caso individual. La joven entiende la dificultad enfrentada por los profesionales, pero afirma que necesitó recurrir a la IA porque su experiencia en el sistema de salud fue «muy difícil» y tuvo que «luchar para ser escuchada».

El caso no prueba que la inteligencia artificial sustituya a los médicos. Prueba que, cuando el sistema falla, pacientes desesperados buscan respuestas donde pueden encontrarlas.

¿Qué opinas de que una joven reciba el diagnóstico correcto de una inteligencia artificial después de 4 años de errores médicos? ¿Confiarías en el ChatGPT para investigar síntomas o crees que es peligroso? Cuéntanos en los comentarios. El debate sobre inteligencia artificial en la salud apenas comienza, y casos como el de Phoebe muestran que la discusión es más urgente de lo que parece.

Portugués

Portugués  Inglés

Inglés  Español

Español

¡Sé la primera persona en reaccionar!